Measure of the joint variability

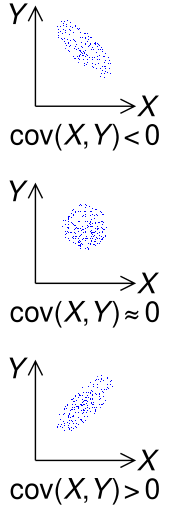

The sign of the covariance of two random variables X and Y 확률 이론 과 통계학 에서, 공분산 (covariance )은 두 개의 확률 변수(random variable) 의 결합 변동가능성의 측정입니다.[1] [2] 선형 관계(linear relationship) 에 있는 경향을 보여줍니다. 공분산의 크기는 해석하기 쉽지 않은데 왜냐하면 그것은 정규화되지 않고 따라서 변수의 크기에 따라 달라지기 때문입니다. 공분산의 정규화된 버전(normalized version of the covariance) , 상관 계수(correlation coefficient) 는, 어쨌든, 선형 관계의 강도를 그의 크기에 의해 보입니다.

구별은 (1) 결합 확률 분포(joint probability distribution) 의 속성으로써 보일 수 있는 모집단(population) 매개변수(parameter) 인 두 확률 변수의 공분산, 그리고 (2) 표본의 기술자로 역할을 하는 것 외에도, 역시 모집단 매개변수의 추정된(estimated) 값으로 역할을 하는 표본(sample) 공분산 사이에 만들어져야 합니다.

Definition 유한한 두 번째 모멘트(second moments) 를 갖는 두 개의 결합적으로 분포된(jointly distributed) 실수 -값 확률 변수(random variables)

X

{\displaystyle X}

Y

{\displaystyle Y}

기댓값(expected value , 또는 평균)으로 정의됩니다:[3] [4] : p. 119

cov

(

X

,

Y

)

=

E

[

(

X

−

E

[

X

]

)

(

Y

−

E

[

Y

]

)

]

{\displaystyle \operatorname {cov} (X,Y)=\operatorname {E} {{\big [}(X-\operatorname {E} [X])(Y-\operatorname {E} [Y]){\big ]}}}

여기서

E

[

X

]

{\displaystyle \operatorname {E} [X]}

X

{\displaystyle X}

X

{\displaystyle X}

분산(variance) 과의 비유에서,

σ

X

Y

{\displaystyle \sigma _{XY}}

σ

(

X

,

Y

)

{\displaystyle \sigma (X,Y)}

cov

(

X

,

Y

)

=

E

[

(

X

−

E

[

X

]

)

(

Y

−

E

[

Y

]

)

]

=

E

[

X

Y

−

X

E

[

Y

]

−

E

[

X

]

Y

+

E

[

X

]

E

[

Y

]

]

=

E

[

X

Y

]

−

E

[

X

]

E

[

Y

]

−

E

[

X

]

E

[

Y

]

+

E

[

X

]

E

[

Y

]

=

E

[

X

Y

]

−

E

[

X

]

E

[

Y

]

,

{\displaystyle {\begin{aligned}\operatorname {cov} (X,Y)&=\operatorname {E} \left[\left(X-\operatorname {E} \left[X\right]\right)\left(Y-\operatorname {E} \left[Y\right]\right)\right]\\&=\operatorname {E} \left[XY-X\operatorname {E} \left[Y\right]-\operatorname {E} \left[X\right]Y+\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]\right]\\&=\operatorname {E} \left[XY\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]+\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]\\&=\operatorname {E} \left[XY\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right],\end{aligned}}}

그러나 이 방정식은 치명적인 취소(catastrophic cancellation) 에 취약합니다 (아래 수치 계산(numerical computation) 섹션을 참조하십시오).

공분산

cov

(

X

,

Y

)

{\displaystyle \operatorname {cov} (X,Y)}

측정의 단위(units of measurement) 는

X

{\displaystyle X}

Y

{\displaystyle Y}

상관 계수(correlation coefficients) 는 선형 의존성의 차원-없는(dimensionless) 측정입니다. (실제로, 상관 계수는 단순히 공분산의 정규화된 버전으로 이해될 수 있습니다.)

Definition for complex random variables 두 개의 복소 확률 변수(complex random variables)

Z

,

W

{\displaystyle Z,W}

[4] : p. 119

cov

(

Z

,

W

)

=

E

[

(

Z

−

E

[

Z

]

)

(

W

−

E

[

W

]

)

¯

]

=

E

[

Z

W

¯

]

−

E

[

Z

]

E

[

W

¯

]

{\displaystyle \operatorname {cov} (Z,W)=\operatorname {E} \left[(Z-\operatorname {E} [Z]){\overline {(W-\operatorname {E} [W])}}\right]=\operatorname {E} \left[Z{\overline {W}}\right]-\operatorname {E} [Z]\operatorname {E} \left[{\overline {W}}\right]}

정의에서 두 번째 인수의 복소 켤레화에 주목하십시오.

관련된 유사-공분산 (pseudo-covariance )

Discrete random variables 만약 (실수) 확률 변수 쌍

(

X

,

Y

)

{\displaystyle (X,Y)}

p

i

=

1

/

n

{\displaystyle p_{i}=1/n}

i

=

1

,

…

,

n

{\displaystyle i=1,\ldots ,n}

(

x

i

,

y

i

)

{\displaystyle (x_{i},y_{i})}

E

[

X

]

{\displaystyle \operatorname {E} [X]}

E

[

Y

]

{\displaystyle \operatorname {E} [Y]}

cov

(

X

,

Y

)

=

1

n

∑

i

=

1

n

(

x

i

−

E

(

X

)

)

(

y

i

−

E

(

Y

)

)

.

{\displaystyle \operatorname {cov} (X,Y)={\frac {1}{n}}\sum _{i=1}^{n}(x_{i}-E(X))(y_{i}-E(Y)).}

평균을 직접적으로 참조 없이 다음과 같이 동등하게 표현될 수도 있습니다:[5]

cov

(

X

,

Y

)

=

1

n

2

∑

i

=

1

n

∑

j

=

1

n

1

2

(

x

i

−

x

j

)

(

y

i

−

y

j

)

=

1

n

2

∑

i

∑

j

>

i

(

x

i

−

x

j

)

(

y

i

−

y

j

)

.

{\displaystyle \operatorname {cov} (X,Y)={\frac {1}{n^{2}}}\sum _{i=1}^{n}\sum _{j=1}^{n}{\frac {1}{2}}(x_{i}-x_{j})(y_{i}-y_{j})={\frac {1}{n^{2}}}\sum _{i}\sum _{j>i}(x_{i}-x_{j})(y_{i}-y_{j}).}

보다 일반적으로, 만약

(

X

,

Y

)

{\displaystyle (X,Y)}

n

{\displaystyle n}

(

x

i

,

y

i

)

{\displaystyle (x_{i},y_{i})}

i

=

1

,

…

,

n

{\displaystyle i=1,\ldots ,n}

cov

(

X

,

Y

)

=

∑

i

=

1

n

p

i

(

x

i

−

E

(

X

)

)

(

y

i

−

E

(

Y

)

)

.

{\displaystyle \operatorname {cov} (X,Y)=\sum _{i=1}^{n}p_{i}(x_{i}-E(X))(y_{i}-E(Y)).}

Example Geometric interpretation of the covariance example. Each cuboid is the axis-aligned bounding box of its point (x , y , f (x , y )), and the X and Y meansThe covariance is the sum of the volumes of the cuboids in the 1st and 3rd quadrants (red) minus those in the 2nd and 4th (blue).

X

{\displaystyle X}

Y

{\displaystyle Y}

결합 확률 질량 함수(joint probability mass function) 를 가지고 있다고 가정하며,[6]

(

x

,

y

)

∈

S

=

{

(

5

,

8

)

,

(

6

,

8

)

,

(

7

,

8

)

,

(

5

,

9

)

,

(

6

,

9

)

,

(

7

,

9

)

}

{\displaystyle (x,y)\in S=\left\{(5,8),(6,8),(7,8),(5,9),(6,9),(7,9)\right\}}

f

(

x

,

y

)

{\displaystyle f(x,y)}

f

(

x

,

y

)

{\displaystyle f(x,y)}

x

f

Y

(

y

)

{\displaystyle f_{Y}(y)}

5

6

7

y

8

0

0.4

0.1

0.5

9

0.3

0

0.2

0.5

f

X

(

x

)

{\displaystyle f_{X}(x)}

0.3

0.4

0.3

1

X

{\displaystyle X}

Y

{\displaystyle Y}

μ

X

=

5

(

0.3

)

+

6

(

0.4

)

+

7

(

0.1

+

0.2

)

=

6

{\displaystyle \mu _{X}=5(0.3)+6(0.4)+7(0.1+0.2)=6}

μ

Y

=

8

(

0.4

+

0.1

)

+

9

(

0.3

+

0.2

)

=

8.5

{\displaystyle \mu _{Y}=8(0.4+0.1)+9(0.3+0.2)=8.5}

cov

(

X

,

Y

)

=

σ

X

Y

=

∑

(

x

,

y

)

∈

S

f

(

x

,

y

)

(

x

−

μ

X

)

(

y

−

μ

Y

)

=

(

0

)

(

5

−

6

)

(

8

−

8.5

)

+

(

0.4

)

(

6

−

6

)

(

8

−

8.5

)

+

(

0.1

)

(

7

−

6

)

(

8

−

8.5

)

+

(

0.3

)

(

5

−

6

)

(

9

−

8.5

)

+

(

0

)

(

6

−

6

)

(

9

−

8.5

)

+

(

0.2

)

(

7

−

6

)

(

9

−

8.5

)

=

−

0.1

.

{\displaystyle {\begin{aligned}\operatorname {cov} (X,Y)={}&\sigma _{XY}=\sum _{(x,y)\in S}f(x,y)\left(x-\mu _{X}\right)\left(y-\mu _{Y}\right)\\[4pt]={}&(0)(5-6)(8-8.5)+(0.4)(6-6)(8-8.5)+(0.1)(7-6)(8-8.5)+{}\\[4pt]&(0.3)(5-6)(9-8.5)+(0)(6-6)(9-8.5)+(0.2)(7-6)(9-8.5)\\[4pt]={}&{-0.1}\;.\end{aligned}}}

Properties Covariance with itself 분산(variance) 은 두 변수가 동일한 공분산의 특수한 경우입니다 (즉, 이것에서 한 변수가 항상 다른 변수와 같은 값을 취합니다):[4] : 121

cov

(

X

,

X

)

=

var

(

X

)

≡

σ

2

(

X

)

≡

σ

X

2

.

{\displaystyle \operatorname {cov} (X,X)=\operatorname {var} (X)\equiv \sigma ^{2}(X)\equiv \sigma _{X}^{2}.}

Covariance of linear combinations 만약

X

{\displaystyle X}

Y

{\displaystyle Y}

W

{\displaystyle W}

V

{\displaystyle V}

a

,

b

,

c

,

d

{\displaystyle a,b,c,d}

cov

(

X

,

a

)

=

0

cov

(

X

,

X

)

=

var

(

X

)

cov

(

X

,

Y

)

=

cov

(

Y

,

X

)

cov

(

a

X

,

b

Y

)

=

a

b

cov

(

X

,

Y

)

cov

(

X

+

a

,

Y

+

b

)

=

cov

(

X

,

Y

)

cov

(

a

X

+

b

Y

,

c

W

+

d

V

)

=

a

c

cov

(

X

,

W

)

+

a

d

cov

(

X

,

V

)

+

b

c

cov

(

Y

,

W

)

+

b

d

cov

(

Y

,

V

)

{\displaystyle {\begin{aligned}\operatorname {cov} (X,a)&=0\\\operatorname {cov} (X,X)&=\operatorname {var} (X)\\\operatorname {cov} (X,Y)&=\operatorname {cov} (Y,X)\\\operatorname {cov} (aX,bY)&=ab\,\operatorname {cov} (X,Y)\\\operatorname {cov} (X+a,Y+b)&=\operatorname {cov} (X,Y)\\\operatorname {cov} (aX+bY,cW+dV)&=ac\,\operatorname {cov} (X,W)+ad\,\operatorname {cov} (X,V)+bc\,\operatorname {cov} (Y,W)+bd\,\operatorname {cov} (Y,V)\end{aligned}}}

실수-값에서 확률 변수의 수열

X

1

,

…

,

X

n

{\displaystyle X_{1},\ldots ,X_{n}}

a

1

,

…

,

a

n

{\displaystyle a_{1},\ldots ,a_{n}}

var

(

∑

i

=

1

n

a

i

X

i

)

=

∑

i

=

1

n

a

i

2

σ

2

(

X

i

)

+

2

∑

i

,

j

:

i

<

j

a

i

a

j

cov

(

X

i

,

X

j

)

=

∑

i

,

j

a

i

a

j

cov

(

X

i

,

X

j

)

{\displaystyle \operatorname {var} \left(\sum _{i=1}^{n}a_{i}X_{i}\right)=\sum _{i=1}^{n}a_{i}^{2}\sigma ^{2}(X_{i})+2\sum _{i,j\,:\,i<j}a_{i}a_{j}\operatorname {cov} (X_{i},X_{j})=\sum _{i,j}{a_{i}a_{j}\operatorname {cov} (X_{i},X_{j})}}

Hoeffding's covariance identity 두 확률 변수

X

,

Y

{\displaystyle X,Y}

[7]

cov

(

X

,

Y

)

=

∫

R

∫

R

(

F

(

X

,

Y

)

(

x

,

y

)

−

F

X

(

x

)

F

Y

(

y

)

)

d

x

d

y

{\displaystyle \operatorname {cov} (X,Y)=\int _{\mathbb {R} }\int _{\mathbb {R} }\left(F_{(X,Y)}(x,y)-F_{X}(x)F_{Y}(y)\right)\,dx\,dy}

여기서

F

(

X

,

Y

)

(

x

,

y

)

{\displaystyle F_{(X,Y)}(x,y)}

(

X

,

Y

)

{\displaystyle (X,Y)}

F

X

(

x

)

,

F

Y

(

y

)

{\displaystyle F_{X}(x),F_{Y}(y)}

주변 분포(marginals) 입니다.

Uncorrelatedness and independence 공분산이 영인 확률 변수는 비-상관된(uncorrelated) 것이라고 불립니다.[4] : p. 121 공분산 행렬(covariance matrix) 이 영인 확률 벡터의 구성 요소도 비-상관된 것이라고 불립니다.

만약

X

{\displaystyle X}

Y

{\displaystyle Y}

독립 확률 변수(independent random variables) 이면, 그것들의 공분산은 영입니다.[4] : p. 123 [8]

E

[

X

Y

]

=

E

[

X

]

⋅

E

[

Y

]

.

{\displaystyle \operatorname {E} [XY]=\operatorname {E} [X]\cdot \operatorname {E} [Y].}

그 전환은, 어쨌든, 일반적으로 참이 아닙니다. 예를 들어,

X

{\displaystyle X}

[

−

1

,

1

]

{\displaystyle [-1,1]}

Y

=

X

2

{\displaystyle Y=X^{2}}

X

{\displaystyle X}

Y

{\displaystyle Y}

cov

(

X

,

Y

)

=

cov

(

X

,

X

2

)

=

E

[

X

⋅

X

2

]

−

E

[

X

]

⋅

E

[

X

2

]

=

E

[

X

3

]

−

E

[

X

]

E

[

X

2

]

=

0

−

0

⋅

E

[

X

2

]

=

0.

{\displaystyle {\begin{aligned}\operatorname {cov} (X,Y)&=\operatorname {cov} \left(X,X^{2}\right)\\&=\operatorname {E} \left[X\cdot X^{2}\right]-\operatorname {E} [X]\cdot \operatorname {E} \left[X^{2}\right]\\&=\operatorname {E} \left[X^{3}\right]-\operatorname {E} [X]\operatorname {E} \left[X^{2}\right]\\&=0-0\cdot \operatorname {E} [X^{2}]\\&=0.\end{aligned}}}

이 경우에서,

Y

{\displaystyle Y}

X

{\displaystyle X}

결합적 정규적으로 분포된(jointly normally distributed) 것이면 (그러나 단순히 개별적 정규적으로 분포된(individually normally distributed) 것이 아니면), 비-상관성이 독립성을 의미합니다 .

Relationship to inner products 공분산의 많은 속성은 안의 곱(inner product) 의 속성과 유사한 속성을 만족시키는 것을 관찰함으로써 우아하게 추출할 수 있습니다:

쌍-선형(bilinear) : 상수

a

{\displaystyle a}

b

{\displaystyle b}

X

,

Y

,

Z

{\displaystyle X,Y,Z}

cov

(

a

X

+

b

Y

,

Z

)

=

a

cov

(

X

,

Z

)

+

b

cov

(

Y

,

Z

)

{\displaystyle \operatorname {cov} (aX+bY,Z)=a\operatorname {cov} (X,Z)+b\operatorname {cov} (Y,Z)}

대칭(symmetric):

cov

(

X

,

Y

)

=

cov

(

Y

,

X

)

{\displaystyle \operatorname {cov} (X,Y)=\operatorname {cov} (Y,X)}

양의 반-한정(positive semi-definite) : 모든 확률 변수

X

{\displaystyle X}

σ

2

(

X

)

=

cov

(

X

,

X

)

≥

0

{\displaystyle \sigma ^{2}(X)=\operatorname {cov} (X,X)\geq 0}

cov

(

X

,

X

)

=

0

{\displaystyle \operatorname {cov} (X,X)=0}

X

{\displaystyle X}

거의 확실하게(almost surely) 상수임을 의미합니다.실제로 이들 속성은 공분산이 유한한 두 번째 모멘트를 갖는 확률 변수의 부분공간을 취하고 상수만큼 다른 임의의 두 개를 식별함으로써 얻은 몫 벡터 공간(quotient vector space) 에 걸쳐 안의 곱을 정의함을 의미합니다. (이 식별은 위의 양의 반-한정성을 양의 한정성으로 바꿉니다.) 해당 몫 벡터 공간은 유한한 두 번째 모멘트와 평균 영을 갖는 확률 변수의 부분공간과 동형적입니다; 해당 부분공간에서, 공분산은 정확히 표본 공간 위에 실수-값 함수의 L2 안의 곱입니다.

그 결과, 유한한 분산을 갖는 확률 변수에 대해, 다음 부등식은

|

cov

(

X

,

Y

)

|

≤

σ

2

(

X

)

σ

2

(

Y

)

{\displaystyle |\operatorname {cov} (X,Y)|\leq {\sqrt {\sigma ^{2}(X)\sigma ^{2}(Y)}}}

코시–슈바르츠 부등식(Cauchy–Schwarz inequality) 을 통해 유지됩니다.

Proof: 만약

σ

2

(

Y

)

=

0

{\displaystyle \sigma ^{2}(Y)=0}

Z

=

X

−

cov

(

X

,

Y

)

σ

2

(

Y

)

Y

.

{\displaystyle Z=X-{\frac {\operatorname {cov} (X,Y)}{\sigma ^{2}(Y)}}Y.}

그런-다음 우리는 다음을 가집니다:

0

≤

σ

2

(

Z

)

=

cov

(

X

−

cov

(

X

,

Y

)

σ

2

(

Y

)

Y

,

X

−

cov

(

X

,

Y

)

σ

2

(

Y

)

Y

)

=

σ

2

(

X

)

−

(

cov

(

X

,

Y

)

)

2

σ

2

(

Y

)

.

{\displaystyle {\begin{aligned}0\leq \sigma ^{2}(Z)&=\operatorname {cov} \left(X-{\frac {\operatorname {cov} (X,Y)}{\sigma ^{2}(Y)}}Y,\;X-{\frac {\operatorname {cov} (X,Y)}{\sigma ^{2}(Y)}}Y\right)\\[12pt]&=\sigma ^{2}(X)-{\frac {(\operatorname {cov} (X,Y))^{2}}{\sigma ^{2}(Y)}}.\end{aligned}}}

Calculating the sample covariance 관찰되지 않은 모집단에서 추출한 각각의

N

{\displaystyle N}

K

{\displaystyle K}

K

×

K

{\displaystyle K\times K}

행렬(matrix)

q

¯

=

[

q

j

k

]

{\displaystyle \textstyle {\overline {\mathbf {q} }}=\left[q_{jk}\right]}

q

j

k

=

1

N

−

1

∑

i

=

1

N

(

X

i

j

−

X

¯

j

)

(

X

i

k

−

X

¯

k

)

,

{\displaystyle q_{jk}={\frac {1}{N-1}}\sum _{i=1}^{N}\left(X_{ij}-{\bar {X}}_{j}\right)\left(X_{ik}-{\bar {X}}_{k}\right),}

이것은 변수

j

{\displaystyle j}

k

{\displaystyle k}

표본 평균과 표본 공분산 행렬은

j

{\displaystyle j}

(

j

=

1

,

…

,

K

)

{\displaystyle (j=1,\,\ldots ,\,K)}

확률 벡터(random vector)

X

{\displaystyle \textstyle \mathbf {X} }

평균(mean) 과 공분산 행렬의 비-편향된 추정(unbiased estimates) 입니다. 표본 공분산 행렬이 분모에서

N

{\displaystyle \textstyle N}

N

−

1

{\displaystyle \textstyle N-1}

E

(

X

)

{\displaystyle \operatorname {E} (\mathbf {X} )}

X

¯

{\displaystyle \mathbf {\bar {X}} }

E

(

X

)

{\displaystyle \operatorname {E} (\mathbf {X} )}

q

j

k

=

1

N

∑

i

=

1

N

(

X

i

j

−

E

(

X

j

)

)

(

X

i

k

−

E

(

X

k

)

)

{\displaystyle q_{jk}={\frac {1}{N}}\sum _{i=1}^{N}\left(X_{ij}-\operatorname {E} \left(X_{j}\right)\right)\left(X_{ik}-\operatorname {E} \left(X_{k}\right)\right)}

Generalizations Auto-covariance matrix of real random vectors 유한한 이차 모멘트를 갖는

m

{\displaystyle m}

X

=

[

X

1

X

2

…

X

m

]

T

{\displaystyle \mathbf {X} ={\begin{bmatrix}X_{1}&X_{2}&\dots &X_{m}\end{bmatrix}}^{\mathrm {T} }}

분산-공분산 행렬 (variance–covariance matrix ) 또는 간단히 공분산 행렬 (covariance matrix )로 알려져 있음)

K

X

X

{\displaystyle \operatorname {K} _{\mathbf {X} \mathbf {X} }}

Σ

(

X

)

{\displaystyle \Sigma (\mathbf {X} )}

cov

(

X

,

X

)

{\displaystyle \operatorname {cov} (\mathbf {X} ,\mathbf {X} )}

[9] : p.335

K

X

X

=

cov

(

X

,

X

)

=

E

[

(

X

−

E

[

X

]

)

(

X

−

E

[

X

]

)

T

]

=

E

[

X

X

T

]

−

E

[

X

]

E

[

X

]

T

.

{\displaystyle {\begin{aligned}\operatorname {K} _{\mathbf {XX} }=\operatorname {cov} (\mathbf {X} ,\mathbf {X} )&=\operatorname {E} \left[(\mathbf {X} -\operatorname {E} [\mathbf {X} ])(\mathbf {X} -\operatorname {E} [\mathbf {X} ])^{\mathrm {T} }\right]\\&=\operatorname {E} \left[\mathbf {XX} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {X} ]\operatorname {E} [\mathbf {X} ]^{\mathrm {T} }.\end{aligned}}}

X

{\displaystyle \mathbf {X} }

Σ 을 갖는 확률 벡터(random vector) 라고 놓고, A

X

{\displaystyle \mathbf {X} }

A X

cov

(

A

X

,

A

X

)

=

E

[

A

X

(

A

X

)

T

]

−

E

[

A

X

]

E

[

(

A

X

)

T

]

=

E

[

A

X

X

T

A

T

]

−

E

[

A

X

]

E

[

X

T

A

T

]

=

A

E

[

X

X

T

]

A

T

−

A

E

[

X

]

E

[

X

T

]

A

T

=

A

(

E

[

X

X

T

]

−

E

[

X

]

E

[

X

T

]

)

A

T

=

A

Σ

A

T

.

{\displaystyle {\begin{aligned}\operatorname {cov} (\mathbf {AX} ,\mathbf {AX} )&=\operatorname {E} \left[\mathbf {AX(A} \mathbf {X)} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {AX} ]\operatorname {E} \left[(\mathbf {A} \mathbf {X} )^{\mathrm {T} }\right]\\&=\operatorname {E} \left[\mathbf {AXX} ^{\mathrm {T} }\mathbf {A} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {AX} ]\operatorname {E} \left[\mathbf {X} ^{\mathrm {T} }\mathbf {A} ^{\mathrm {T} }\right]\\&=\mathbf {A} \operatorname {E} \left[\mathbf {XX} ^{\mathrm {T} }\right]\mathbf {A} ^{\mathrm {T} }-\mathbf {A} \operatorname {E} [\mathbf {X} ]\operatorname {E} \left[\mathbf {X} ^{\mathrm {T} }\right]\mathbf {A} ^{\mathrm {T} }\\&=\mathbf {A} \left(\operatorname {E} \left[\mathbf {XX} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {X} ]\operatorname {E} \left[\mathbf {X} ^{\mathrm {T} }\right]\right)\mathbf {A} ^{\mathrm {T} }\\&=\mathbf {A} \Sigma \mathbf {A} ^{\mathrm {T} }.\end{aligned}}}

이것은 기대(expectation) 의 선형성의 직접적인 결과이고 벡터에 백색화 변환(whitening transformation) 과 같은 선형 변환(linear transformation) 을 적용할 때 유용합니다.

Cross-covariance matrix of real random vectors 실수 확률 벡터(random vectors)

X

∈

R

m

{\displaystyle \mathbf {X} \in \mathbb {R} ^{m}}

Y

∈

R

n

{\displaystyle \mathbf {Y} \in \mathbb {R} ^{n}}

m

×

n

{\displaystyle m\times n}

[9] : p.336

K

X

Y

=

cov

(

X

,

Y

)

=

E

[

(

X

−

E

[

X

]

)

(

Y

−

E

[

Y

]

)

T

]

=

E

[

X

Y

T

]

−

E

[

X

]

E

[

Y

]

T

{\displaystyle {\begin{aligned}\operatorname {K} _{\mathbf {X} \mathbf {Y} }=\operatorname {cov} (\mathbf {X} ,\mathbf {Y} )&=\operatorname {E} \left[(\mathbf {X} -\operatorname {E} [\mathbf {X} ])(\mathbf {Y} -\operatorname {E} [\mathbf {Y} ])^{\mathrm {T} }\right]\\&=\operatorname {E} \left[\mathbf {X} \mathbf {Y} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {X} ]\operatorname {E} [\mathbf {Y} ]^{\mathrm {T} }\end{aligned}}}

(Eq.2 )

여기서

Y

T

{\displaystyle \mathbf {Y} ^{\mathrm {T} }}

Y

{\displaystyle \mathbf {Y} }

전치(transpose) 입니다.

이 행렬의

(

i

,

j

)

{\displaystyle (i,j)}

X

{\displaystyle \mathbf {X} }

i

Y

{\displaystyle \mathbf {Y} }

j

cov

(

X

i

,

Y

j

)

{\displaystyle \operatorname {cov} (X_{i},Y_{j})}

cov

(

Y

,

X

)

{\displaystyle \operatorname {cov} (\mathbf {Y} ,\mathbf {X} )}

cov

(

X

,

Y

)

{\displaystyle \operatorname {cov} (\mathbf {X} ,\mathbf {Y} )}

전치(transpose) 입니다.

Cross-covariance sesquilinear form of random vectors in a real or complex Hilbert space 보다 일반적으로

H

1

=

(

H

1

,

⟨

,

⟩

1

)

{\displaystyle H_{1}=(H_{1},\langle \,,\rangle _{1})}

H

2

=

(

H

2

,

⟨

,

⟩

2

)

{\displaystyle H_{2}=(H_{2},\langle \,,\rangle _{2})}

⟨

,

⟩

{\displaystyle \langle \,,\rangle }

R

{\displaystyle \mathbb {R} }

C

{\displaystyle \mathbb {C} }

힐베르트 공간(Hilbert spaces) 이라고 놓고,

X

,

Y

{\displaystyle \mathbf {X} ,\mathbf {Y} }

H

1

{\displaystyle H_{1}}

H

2

{\displaystyle H_{2}}

X

{\displaystyle \mathbf {X} }

Y

{\displaystyle \mathbf {Y} }

H

1

×

H

2

{\displaystyle H_{1}\times H_{2}}

반-쌍선형(sesquilinear) 형식 (첫 번째 변수에서 역 선형)입니다.

K

X

,

Y

(

h

1

,

h

2

)

=

cov

(

X

,

Y

)

(

h

1

,

h

2

)

=

E

[

⟨

h

1

,

(

X

−

E

[

X

]

)

⟩

1

⟨

(

Y

−

E

[

Y

]

)

,

h

2

⟩

2

]

=

E

[

⟨

h

1

,

X

⟩

1

⟨

Y

,

h

2

⟩

2

]

−

E

[

⟨

h

,

X

⟩

1

]

E

[

⟨

Y

,

h

2

⟩

2

]

=

⟨

h

1

,

E

[

(

X

−

E

[

X

]

)

(

Y

−

E

[

Y

]

)

†

]

h

2

⟩

1

=

⟨

h

1

,

(

E

[

X

Y

†

]

−

E

[

X

]

E

[

Y

]

†

)

h

2

⟩

1

{\displaystyle {\begin{aligned}\operatorname {K} _{X,Y}(h_{1},h_{2})=\operatorname {cov} (\mathbf {X} ,\mathbf {Y} )(h_{1},h_{2})&=\operatorname {E} \left[\langle h_{1},(\mathbf {X} -\operatorname {E} [\mathbf {X} ])\rangle _{1}\langle (\mathbf {Y} -\operatorname {E} [\mathbf {Y} ]),h_{2}\rangle _{2}\right]\\&=\operatorname {E} [\langle h_{1},\mathbf {X} \rangle _{1}\langle \mathbf {Y} ,h_{2}\rangle _{2}]-\operatorname {E} [\langle h,\mathbf {X} \rangle _{1}]\operatorname {E} [\langle \mathbf {Y} ,h_{2}\rangle _{2}]\\&=\langle h_{1},\operatorname {E} \left[(\mathbf {X} -\operatorname {E} [\mathbf {X} ])(\mathbf {Y} -\operatorname {E} [\mathbf {Y} ])^{\dagger }\right]h_{2}\rangle _{1}\\&=\langle h_{1},\left(\operatorname {E} [\mathbf {X} \mathbf {Y} ^{\dagger }]-\operatorname {E} [\mathbf {X} ]\operatorname {E} [\mathbf {Y} ]^{\dagger }\right)h_{2}\rangle _{1}\\\end{aligned}}}

Numerical computation

E

[

X

Y

]

≈

E

[

X

]

E

[

Y

]

{\displaystyle \operatorname {E} [XY]\approx \operatorname {E} [X]\operatorname {E} [Y]}

cov

(

X

,

Y

)

=

E

[

X

Y

]

−

E

[

X

]

E

[

Y

]

{\displaystyle \operatorname {cov} (X,Y)=\operatorname {E} \left[XY\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]}

E

[

X

Y

]

{\displaystyle \operatorname {E} \left[XY\right]}

E

[

X

]

E

[

Y

]

{\displaystyle \operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]}

치명적인 취소( catastrophic cancellation) 가 발생하기 쉽고 따라서 이전에 데이터가 중앙에 배치되지 않았을 때 컴퓨터 프로그램에서 피해야 합니다.[10] 수치적으로 안정적인 알고리듬(Numerically stable algorithms) 이 이 경우에서 선호되어야 합니다.[11]

공분산은 때때로 두 개의 확률 변수 사이의 "선형 종속성"의 측정이라고 불립니다. 그것은 선형 대수(linear algebra) 의 문맥에서와 같은 것을 의미하지 않습니다 (선형 의존성(linear dependence) 을 참조하십시오). 공분산이 정규화될 때, 변수 간의 관계를 설명하는 최상의 가능한 선형 함수에 대한 적합도를 제공하는 피어슨 상관 계수(Pearson correlation coefficient) 를 얻습니다. 이런 의미에서 공분산은 종속성의 선형 척도입니다.

Applications In genetics and molecular biology 공분산은 생물학에서 중요한 측정입니다. DNA 의 특정 서열은 종 사이에서 다른 것보다 더 많이 보존되고, 따라서 단백질의 2차 및 3차 구조 또는 RNA 구조를 연구하기 위해, 밀접하게 관련된 종의 서열을 비교합니다. 만약 서열 변화가 발견되거나 비-부호화 RNA(noncoding RNA , 예를 들어 microRNA )에서 전혀 변화가 발견되지 않으면, 서열은 RNA 루프와 같은 공통적인 구조 모티프에 필요한 것으로 밝혀졌습니다. 유전학에서, 공분산은 Genetic Relationship Matrix(GRM, 일명 친족 행렬)의 계산에 대해 기초 역할을 하며, 가까운 친척이 알려지지 않은 표본의 인구 구조에 대한 추론과 복잡한 특성의 유전 가능성 추정에 대한 추론을 가능하게 합니다.

진화론과 자연 선택론에서, 가격 방정식 (Price equation ) 은 시간이 지남에 따라 유전적 특성의 빈도가 어떻게 변하는지 설명합니다. 그 방정식은 진화와 자연 선택에 대한 수학적 설명을 제공하기 위해 특성과 적합도(fitness) 사이의 공분산 을 사용합니다. 그것은 유전자 전달과 자연 선택이 인구의 각 새로운 세대 내에서 유전자의 비율에 미치는 영향을 이해하는 방법을 제공합니다.[12] [13] W.D. Hamilton 의 친족 선택 작업을 다시 도출하기 위해 George R. Price 에 의해 도출되었습니다. 가격 방정식의 예제는 다양한 진화 사례에 대해 구성되었습니다.

In financial economics 공분산은 금융 경제학, 특히 현대 포트폴리오 이론과 자본 자산 가격 책정 모델에서 중요한 역할을 합니다. 다양한 자산의 수익률 사이의 공분산은 특정 가정 아래에서 투자자가 다양화 맥락에서 보유하기 위해 (긍정적 분석에서) 예측되거나 (규범적 분석에서) 예측해야 하는 다양한 자산의 상대적인 금액을 결정하는 데 사용됩니다.

In meteorological and oceanographic data assimilation 공분산 행렬은 데이터 동화(data assimilation) 로 알려진 절차, 일기 예보 모델을 실행하는 데 필요한 초기 조건을 추정하는 데 중요합니다. '예측 오차 공분산 행렬'은 전형적으로 평균 상태 (기후학적 또는 앙상블 평균) 주변의 섭동 사이에서 구성됩니다. '관측 오차 공분산 행렬'은 (대각선 위에) 결합된 관측 오차와 측정 사이의 (대각선 밖의) 상관 오차를 나타내도록 구성됩니다. 이것은 칼만 필터링(Kalman filtering) 에 대한 광범위한 적용과 시간-변하는 시스템에 대한 보다 일반적인 상태 추정(state estimation) 의 예입니다.

In micrometeorology 에디 공분산(eddy covariance) 기법은 평균 값에서 수직 풍속의 순간 편차와 가스 농도에서 순간 편차 사이의 공분산이 수직 난류 플럭스 계산의 기초가 되는 주요 대기 측정 기법입니다.

In signal processing 공분산 행렬은 신호의 스펙트럼 변동성을 포획하는 데 사용됩니다.[14]

In statistics and image processing 공분산 행렬은 주요 성분 해석(principal component analysis) 에서 데이터 전처리(data preprocessing) 에서 기능 차원성을 줄이기 위해 사용됩니다.

See also References

^ Rice, John (2007). Mathematical Statistics and Data Analysis . Belmont, CA: Brooks/Cole Cengage Learning. p. 138. ISBN 978-0534-39942-9 ^ Weisstein, Eric W. "Covariance" . MathWorld ^ Oxford Dictionary of Statistics, Oxford University Press, 2002, p. 104.

^ a b c d e Park,Kun Il (2018). Fundamentals of Probability and Stochastic Processes with Applications to Communications . Springer. ISBN 978-3-319-68074-3 ^ Some new deformation formulas about variance and covariance . Proceedings of 4th International Conference on Modelling, Identification and Control(ICMIC2012). June 2012. pp. 987–992.^ "Covariance of X and Y | STAT 414/415" . The Pennsylvania State University. Archived from the original on August 17, 2017. Retrieved August 4, 2019 .^ Papoulis (1991). Probability, Random Variables and Stochastic Processes . McGraw-Hill. ^ Siegrist, Kyle. "Covariance and Correlation" . University of Alabama in Huntsville. Retrieved Oct 3, 2022 . ^ a b Gubner, John A. (2006). Probability and Random Processes for Electrical and Computer Engineers . Cambridge University Press. ISBN 978-0-521-86470-1 ^ Donald E. Knuth (1998). The Art of Computer Programming Seminumerical Algorithms , 3rd edn., p. 232. Boston: Addison-Wesley.^ Schubert, Erich; Gertz, Michael (2018). "Numerically stable parallel computation of (co-)variance" . Proceedings of the 30th International Conference on Scientific and Statistical Database Management – SSDBM '18 . Bozen-Bolzano, Italy: ACM Press: 1–12. doi :10.1145/3221269.3223036 . ISBN 9781450365055 S2CID 49665540 . ^ Price, George (1970). "Selection and covariance". Nature 227 (5257): 520–521. Bibcode :1970Natur.227..520P . doi :10.1038/227520a0 . PMID 5428476 . S2CID 4264723 . ^ Harman, Oren (2020). "When science mirrors life: on the origins of the Price equation" . Phil. Trans. R. Soc. B . 375 (1797): 1–7. doi :10.1098/rstb.2019.0352 PMC 7133509 PMID 32146891 . Retrieved 2020-05-15 . ^ Sahidullah, Md.; Kinnunen, Tomi (March 2016). "Local spectral variability features for speaker verification" . Digital Signal Processing . 50 : 1–11. doi :10.1016/j.dsp.2015.10.011 .

![{\displaystyle \operatorname {cov} (X,Y)=\operatorname {E} {{\big [}(X-\operatorname {E} [X])(Y-\operatorname {E} [Y]){\big ]}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/f98a8bf924edb41a8025b5ffaa1b255b4a6f48b9)

![{\displaystyle \operatorname {E} [X]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/44dd294aa33c0865f58e2b1bdaf44ebe911dbf93)

![{\displaystyle {\begin{aligned}\operatorname {cov} (X,Y)&=\operatorname {E} \left[\left(X-\operatorname {E} \left[X\right]\right)\left(Y-\operatorname {E} \left[Y\right]\right)\right]\\&=\operatorname {E} \left[XY-X\operatorname {E} \left[Y\right]-\operatorname {E} \left[X\right]Y+\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]\right]\\&=\operatorname {E} \left[XY\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]+\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]\\&=\operatorname {E} \left[XY\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right],\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/b82a8c24b0063ffd95d8624f460acaaacb2a99b3)

![{\displaystyle \operatorname {cov} (Z,W)=\operatorname {E} \left[(Z-\operatorname {E} [Z]){\overline {(W-\operatorname {E} [W])}}\right]=\operatorname {E} \left[Z{\overline {W}}\right]-\operatorname {E} [Z]\operatorname {E} \left[{\overline {W}}\right]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/cc823fe25634365b1859a3ee206ca894203a9ee2)

![{\displaystyle \operatorname {E} [Y]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/639e8577c6faffc0471c7e123ead30970034e6d5)

![{\displaystyle {\begin{aligned}\operatorname {cov} (X,Y)={}&\sigma _{XY}=\sum _{(x,y)\in S}f(x,y)\left(x-\mu _{X}\right)\left(y-\mu _{Y}\right)\\[4pt]={}&(0)(5-6)(8-8.5)+(0.4)(6-6)(8-8.5)+(0.1)(7-6)(8-8.5)+{}\\[4pt]&(0.3)(5-6)(9-8.5)+(0)(6-6)(9-8.5)+(0.2)(7-6)(9-8.5)\\[4pt]={}&{-0.1}\;.\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/8a80fa4db641ca7ddd6f7a3fee8620eed15321a7)

![{\displaystyle \operatorname {E} [XY]=\operatorname {E} [X]\cdot \operatorname {E} [Y].}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/c0c2870ec57051083bd6262aa4069a2500dfda44)

![{\displaystyle [-1,1]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/51e3b7f14a6f70e614728c583409a0b9a8b9de01)

![{\displaystyle {\begin{aligned}\operatorname {cov} (X,Y)&=\operatorname {cov} \left(X,X^{2}\right)\\&=\operatorname {E} \left[X\cdot X^{2}\right]-\operatorname {E} [X]\cdot \operatorname {E} \left[X^{2}\right]\\&=\operatorname {E} \left[X^{3}\right]-\operatorname {E} [X]\operatorname {E} \left[X^{2}\right]\\&=0-0\cdot \operatorname {E} [X^{2}]\\&=0.\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/19b6f2d636d5ef9ba85b6350e49222109a28d665)

![{\displaystyle {\begin{aligned}0\leq \sigma ^{2}(Z)&=\operatorname {cov} \left(X-{\frac {\operatorname {cov} (X,Y)}{\sigma ^{2}(Y)}}Y,\;X-{\frac {\operatorname {cov} (X,Y)}{\sigma ^{2}(Y)}}Y\right)\\[12pt]&=\sigma ^{2}(X)-{\frac {(\operatorname {cov} (X,Y))^{2}}{\sigma ^{2}(Y)}}.\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/fc8741ab12cb5943efe9d8dbfeb455517bc63347)

![{\displaystyle \textstyle {\overline {\mathbf {q} }}=\left[q_{jk}\right]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/cb28ac928a2a379d039d27fb99d56dd21c1c027c)

![{\displaystyle {\begin{aligned}\operatorname {K} _{\mathbf {XX} }=\operatorname {cov} (\mathbf {X} ,\mathbf {X} )&=\operatorname {E} \left[(\mathbf {X} -\operatorname {E} [\mathbf {X} ])(\mathbf {X} -\operatorname {E} [\mathbf {X} ])^{\mathrm {T} }\right]\\&=\operatorname {E} \left[\mathbf {XX} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {X} ]\operatorname {E} [\mathbf {X} ]^{\mathrm {T} }.\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/15725714f72a46ffb0686bafdb209260b842ac39)

![{\displaystyle {\begin{aligned}\operatorname {cov} (\mathbf {AX} ,\mathbf {AX} )&=\operatorname {E} \left[\mathbf {AX(A} \mathbf {X)} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {AX} ]\operatorname {E} \left[(\mathbf {A} \mathbf {X} )^{\mathrm {T} }\right]\\&=\operatorname {E} \left[\mathbf {AXX} ^{\mathrm {T} }\mathbf {A} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {AX} ]\operatorname {E} \left[\mathbf {X} ^{\mathrm {T} }\mathbf {A} ^{\mathrm {T} }\right]\\&=\mathbf {A} \operatorname {E} \left[\mathbf {XX} ^{\mathrm {T} }\right]\mathbf {A} ^{\mathrm {T} }-\mathbf {A} \operatorname {E} [\mathbf {X} ]\operatorname {E} \left[\mathbf {X} ^{\mathrm {T} }\right]\mathbf {A} ^{\mathrm {T} }\\&=\mathbf {A} \left(\operatorname {E} \left[\mathbf {XX} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {X} ]\operatorname {E} \left[\mathbf {X} ^{\mathrm {T} }\right]\right)\mathbf {A} ^{\mathrm {T} }\\&=\mathbf {A} \Sigma \mathbf {A} ^{\mathrm {T} }.\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/c1b2123c32a8acefc209a4f69d571ee1197a8c59)

![{\displaystyle {\begin{aligned}\operatorname {K} _{\mathbf {X} \mathbf {Y} }=\operatorname {cov} (\mathbf {X} ,\mathbf {Y} )&=\operatorname {E} \left[(\mathbf {X} -\operatorname {E} [\mathbf {X} ])(\mathbf {Y} -\operatorname {E} [\mathbf {Y} ])^{\mathrm {T} }\right]\\&=\operatorname {E} \left[\mathbf {X} \mathbf {Y} ^{\mathrm {T} }\right]-\operatorname {E} [\mathbf {X} ]\operatorname {E} [\mathbf {Y} ]^{\mathrm {T} }\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/99e6f5ef675f7bb826d04f206bd212d14632ab8c)

![{\displaystyle {\begin{aligned}\operatorname {K} _{X,Y}(h_{1},h_{2})=\operatorname {cov} (\mathbf {X} ,\mathbf {Y} )(h_{1},h_{2})&=\operatorname {E} \left[\langle h_{1},(\mathbf {X} -\operatorname {E} [\mathbf {X} ])\rangle _{1}\langle (\mathbf {Y} -\operatorname {E} [\mathbf {Y} ]),h_{2}\rangle _{2}\right]\\&=\operatorname {E} [\langle h_{1},\mathbf {X} \rangle _{1}\langle \mathbf {Y} ,h_{2}\rangle _{2}]-\operatorname {E} [\langle h,\mathbf {X} \rangle _{1}]\operatorname {E} [\langle \mathbf {Y} ,h_{2}\rangle _{2}]\\&=\langle h_{1},\operatorname {E} \left[(\mathbf {X} -\operatorname {E} [\mathbf {X} ])(\mathbf {Y} -\operatorname {E} [\mathbf {Y} ])^{\dagger }\right]h_{2}\rangle _{1}\\&=\langle h_{1},\left(\operatorname {E} [\mathbf {X} \mathbf {Y} ^{\dagger }]-\operatorname {E} [\mathbf {X} ]\operatorname {E} [\mathbf {Y} ]^{\dagger }\right)h_{2}\rangle _{1}\\\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/a5e62db23468fadd6a7f877ed44ede2bfbc07365)

![{\displaystyle \operatorname {E} [XY]\approx \operatorname {E} [X]\operatorname {E} [Y]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/5cc8091d0da21aa8f5a114797ba5113ddf534f69)

![{\displaystyle \operatorname {cov} (X,Y)=\operatorname {E} \left[XY\right]-\operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/bdf56a30f7ff1be354713f144bfd02ba949a77f4)

![{\displaystyle \operatorname {E} \left[XY\right]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/128f7734bafe2a92d25d3df5fbb614e1d22b2e45)

![{\displaystyle \operatorname {E} \left[X\right]\operatorname {E} \left[Y\right]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/f05701ae57cc8e32cd812037d7ba5d3d433021d4)