Binomial distribution

|

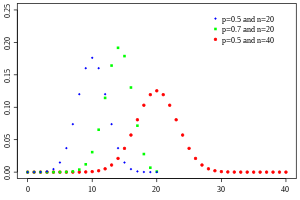

Probability mass function  | |||

|

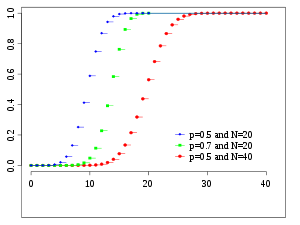

Cumulative distribution function  | |||

| Notation | |||

|---|---|---|---|

| Parameters |

– number of trials – success probability for each trial | ||

| Support | – number of successes | ||

| PMF | |||

| CDF | |||

| Mean | |||

| Median | or | ||

| Mode | or | ||

| Variance | |||

| Skewness | |||

| Ex. kurtosis | |||

| Entropy |

in shannons. For nats, use the natural log in the log. | ||

| MGF | |||

| CF | |||

| PGF | |||

| Fisher information |

(for fixed ) | ||

with n and k as in Pascal's triangle

The probability that a ball in a Galton box with 8 layers (n = 8) ends up in the central bin (k = 4) is .

확률 이론(probability theory) 및 통계학(statistics)에서, 매개 변수 n 및 p를 갖는 이항 분포(binomial distribution)는 n 독립(independent) 실험(experiment)의 수열에서 성공의 숫자의 이산 확률 분포(discrete probability distribution)이며, 각각은 예-아니오 질문을 요구하고, 각각은 자체 부울(boolean)-값 결과(outcome): 성공(success)/예(yes)/참(true)/일 (확률 p) 또는 실패(failure)/아니오(no)/거짓(false)/영 (확률 q = 1 − p)을 가집니다. 단일 성공/실패 실험은 베르누이 시행(Bernoulli trial) 또는 베르누이 실험으로 역시 불리고 결과의 수열은 베르누이 과정(Bernoulli process)으로 불립니다; 단일 시행, 즉, n = 1에 대해, 이항 분포는 베르누이 분포(Bernoulli distribution)입니다. 이항 분포는 통계적 중요성(statistical significance)의 인기있는 이항 테스트(binomial test)의 기초입니다.

이항 분포는 크기 N의 모집단으로부터 복원과 함께(with replacement) 추출되는 크기 n의 표본에서 성공의 숫자를 모델링하기 위해 자주 사용됩니다. 만약 표본화가 복원없이 수행되면, 추출은 독립이 아니고 따라서 초래하는 분포는, 이항 분포가 아닌, 초기하 분포(hypergeometric distribution)입니다. 어쨌든, n보다 훨씬 큰 N에 대해, 이항 분포는 좋은 근사로 남아 있고, 널리 사용됩니다.

Definitions

Probability mass function

일반적으로, 만약 확률 변수(random variable) X는 매개-변수 n ∈ ℕ 및 p ∈ [0,1]를 갖는 이항 분포를 따르며, 우리는 X ~ B(n, p)로 씁니다. n 독립 베르누이 시행에서 정확히 k 성공을 얻을 확률은 k = 0, 1, 2, ..., n에 대해 확률 질량 함수(probability mass function)에 의해 제공됩니다:

여기서

는 이항 계수(binomial coefficient)이며, 따라서 분포의 이름입니다. 공식은 다음처럼 이해될 수 있습니다. k 성공은 확률 pk로 발생하고 n − k 실패는 확률 (1 − p)n − k로 발생합니다. 어쨌든, k 성공은 n 시행 사이에 어디에서나 발생할 수 있고, n 시행의 수열에서 k 성공을 분배하는 다른 방법이 있습니다.

이항 분포 확률에 대해 참조 테이블을 만드는 것에서, 보통 테이블은 n/2 값까지 채워집니다. 이것은 k > n/2에 대해, 확률은 다음으로 그의 여집합에 의해 확률을 계산할 수 있기 때문입니다.

표현 f(k, n, p)를 k의 함수로 보면, 그것을 최대화하는 k 값이 있습니다. 이 k 값은 다음을 계산하고 그것을 1과 비교함으로써 구할 수 있습니다:

- .

다음을 만족시키는 정수 M이 항상 있습니다:[1]

(n + 1)p가 정수인 경우의 제외와 함께, f(k, n, p)는 k < M에 대해 단조 증가하고 k > M에 대해 단조 감소입니다. 이 경우에서, f가 최대인 두 값이 있습니다: (n + 1)p 및 (n + 1)p − 1입니다. M은 베르누이 시행의 가장 가능성이 높은 결과 (비록 이것이 여전히 전체적으로 보이지는 않지만)이고 최빈값(mode)으로 불립니다.

Cumulative distribution function

누적 분포 함수(cumulative distribution function)는 다음으로 표현될 수 있습니다:

여기서 는 k 아래 바닥, 즉, k보다 작거나 같은 가장 큰 정수(greatest integer)입니다.

역시 다음으로 정규화된 불완전 베타 함수(regularized incomplete beta function)의 관점에서 표현될 수 있습니다:[2]

이것은 F-분포(F-distribution)의 누적 분포 함수(cumulative distribution function)와 동등합니다:[3]

누적 분포 함수에 대해 일부 닫힌-형식 경계는 아래에 제공됩니다.

Example

편향된 동전(biased coin)이 던져질 때 확률 0.3과 함께 앞면이 나온다고 가정합니다. 6 던짐에서 정확히 4 앞면을 볼 확률은 다음입니다:

Properties

Expected value and variance

만약 X ~ B(n, p), 즉 X가 이항적으로 분포된 확률 변수이며, 여기서 n은 실험의 전체 횟수이고 p가 성공적인 결과를 산출하는 각 실험의 확률이면, X의 기댓값(expected value)은 다음입니다:[4]

이것은 X가 각각 기댓값 p를 갖는 n 동일한 베르누이 확률 변수의 합이라는 사실과 함께 기댓값의 선형성에서 따릅니다. 달리 말해서, 만약 가 매개-변수 p를 갖는 동일한 (및 독립) 베르누이 확률 변수이면, 이고

분산(variance)는 다음입니다:

이것은 독립 확률 변수의 합의 분산이 분산의 합이라는 사실로부터 유사하게 따릅니다.

Higher moments

처음 6 중심 모멘트는 다음에 의해 제공됩니다:

Mode

보통 이항 B(n, p) 분포의 최빈값(mode)은 와 같으며, 여기서 는 바닥 함수(floor function)입니다. 어쨌든, (n + 1)p가 정수이고 p가 0도 아니고 1도 아니면, 분포는 두 최빈값: (n + 1)p 및 (n + 1)p − 1을 가집니다. p가 0 또는 1과 같을 때, 최빈값은 상응하는 0 및 n이 될 것입니다. 이들 경우는 다음과 같이 요약될 수 있습니다:

증명: 다음을 놓습니다:

에 대해, 오직 는 과 함께 비-영 값을 가집니다. 에 대해, 우리는 을 찾고 에 대해 을 찾습니다. 이것은 최빈값이 에 대해 0 및 에 대해 임을 입증합니다.

을 놓습니다. 우리는 다음을 찾습니다:

- .

이것으로부터 따릅니다:

따라서 가 정수일 때, 및 는 최빈값입니다. 인 경우에서, 오직 이 최빈값입니다.[5]

Median

일반적으로, 이항 분포에 대해 중앙값(median)을 구하기 위한 단일 공식은 없고, 그것은 심지어 고유하지 않을 수 있습니다. 어쨌든 여러 특별한 결과가 확립되어 왔습니다:

- 만약 np가 정수이면, 평균, 중앙값, 및 최빈값은 일치하고 np와 같습니다.[6][7]

- 임의의 중앙값 m은 구간 ⌊np⌋ ≤ m ≤ ⌈np⌉ 이내에 반드시 놓입니다.[8]

- 중앙값 m은 평균에서 너무 멀리 떨어져있을 수 없습니다: |m − np| ≤ min{ ln 2, max{p, 1 − p} }.[9]

- 중앙값은 고유하고 |m − np| ≤ min{p, 1 − p}일 때 m = round(np)와 같습니다 (p = 1/2이고 n이 홀수일 때 경우를 제외합니다).[8]

- p = 1/2이고 n이 홀수일 때, 구간 1/2(n − 1) ≤ m ≤ 1/2(n + 1)에서 임의의 숫자 m은 이항 분포의 중앙값입니다. 만약 p = 1/2이고 n이 짝수이면, m = n/2는 고유한 중앙값입니다.

Tail bounds

k ≤ np에 대해, 분포 함수의 아래쪽 꼬리에 대한 위쪽 경계(upper bounds)는 유도될 수 있습니다. 많아야 k 성공이 있는 확률, 임을 다시-기억하십시오.

하프딩의 부등식(Hoeffding's inequality)은 다음 경계를 산출합니다:

그리고 체르노프의 부등식(Chernoff's inequality)은 다음 경계를 도출하기 위해 사용됩니다:

게다가, 이들 경계는 p = 1/2일 때 합리적으로 촘촘한데, 왜냐하면 다음 표현은 짝수 n을 갖는 모든 k ≥ 3n/8에 대해 유지됩니다:[10]

어쨌든, 그 경계는 p의 극단 값에 대해 잘 작동하지 않습니다. 특히, p 1일 때, 값 F(k;n,p)는 영으로 가지만 (고정된 k에 대해 k < n을 갖는 n), 위의 위쪽 경계는 양의 상수로 갑니다. 이 경우에서 더 나은 경계는 다음에 의해 제공됩니다: [11]

여기서 D(a || p)는 a-동전과 p-동전 사이 (즉, 베르누이(a)와 베르누이(p) 분포 사이)의 상대 엔트로피(relative entropy)입니다:

점근적으로, 이 경계는 상당히 촘촘합니다; 자세한 내용에 대해 문헌[11]을 참조하십시오. 경계의 동등한 공식은 다음입니다:

양쪽 이들 경계는 체르노프 경계(Chernoff bound)로부터 직접 유도됩니다. 역시 다음임을 보일 수 있습니다:

이것은 유형의 방법을 사용하여 입증됩니다 (예를 들어 클로버와 토마스에 의한 Elements of Information Theory의 11장 참조하십시오[12]).

우리는 역시 스털링 공식과 함께 이항 계수를 근사함으로써 분모에서 을 으로 변경할 수 있습니다.[13]

추가적으로, 분모에서 은 이항과 표준 정규 분포 사이의 관계를 이용하고, 밀스의 비율의 근사를 적용함으로써 로 역시 변경될 수 있습니다.[14]

Statistical Inference

Estimation of parameters

n이 알려진 있으면, 매개-변수 p는 성공의 비율: 을 사용하여 추정될 수 있습니다. 이 추정기는 최대 가능도 추정기(maximum likelihood estimator)와 역시 모멘트의 방법(method of moments)을 사용하여 구해집니다. 이 추정기는 레만–셰페 정리(Lehmann–Scheffé theorem)를 사용하여 입증된 최소 분산(minimum variance)을 갖는 불-편향(unbiased)이고 균일한 것인데, 왜냐하면 그것은 최소의 충분(minimal sufficient)이고 완전한(complete) 통계량 (즉: x)에 기초하기 때문입니다. 역시 확률과 MSE 둘 다에서 일관성(consistent)이 있습니다.

p에 대해 닫힌 형식 베이즈 추정기(Bayes estimator)는 켤레(conjugate) 이전 분포(prior distribution)로 베타 분포(Beta distribution)를 사용할 때 역시 존재합니다. 일반적인 를 이전으로 사용할 때, 이후 평균(posterior mean) 추정량은 입니다. 베이즈 추정기는 점근적으로 효율적(asymptoticly efficient)이고 표본 크기가 무한대로 접근할 때 (n → ∞), 그것은 MLE 해에 접근합니다. 베이즈 추정기는 확률론에서 편향된(biased) (이전에 따라 얼마나 많은지), 허용-가능(admissible)이고 일관된(consistent) 것입니다.

비-정보를-주는 이전(non-informative prior)으로 표준 균등 분포(standard uniform distribution)를 사용하는 특수한 경우 ()에 대해, 사후 평균 추정기가 가 됩니다 (사후 최빈값(posterior mode)은 표준 추정기로 바로 이어져야 합니다). 이 방법은 후속의 규칙으로 불리며, 이것은 18세기에 피에르-시몽 라플라스(Pierre-Simon Laplace)에 의해 도입되었습니다.

매우 드문 사건 및 작은 n (예를 들어: 만약 x=0이면)과 함께 p를 추정할 때, 표준 추정기를 사용하면 로 이어지며, 이것은 때때로 비-현실적이고 비-바람직한 것입니다. 그러한 경우에서, 다양한 대안적인 추정기가 있습니다.[15] 한 방법은 베이즈 추정기를 사용하는 것이며, 로 이어집니다. 또 다른 방법은 삼의 규칙(rule of three): 을 사용하여 얻어진 신뢰 구간(confidence interval)의 위쪽 경계를 사용하는 것입니다.

Confidence intervals

n의 꽤 큰 값에 대해 심지어, 평균의 실제 분포는 크게 비정규입니다.[16] 이 문제때문에, 신뢰 구간을 추정하기 위한 여러 방법이 제안되어 왔습니다.

아래의 신뢰 구간에 대해 방정식에서, 변수는 다음 의미를 가집니다:

- n1은 n, 시행의 총 횟수 중 성공의 숫자입니다.

- 은 성공의 비율입니다.

- 는 목표 오차율 에 해당하는 표본 정규 분포 (즉, 프로빗(probit))의 분위-숫자(quantile)입니다. 예를 들어, 95% 신뢰 구간에 대해 오차 = 0.05이므로, = 0.975 and = 1.96입니다.

Wald method

- 0.5/n의 연속성 보정(continuity correction)이 더해질 수 있습니다.[clarification needed]

Agresti–Coull method

- 여기서 p의 추정치는 다음과 같이 수정됩니다:

Arcsine method

Wilson (score) method

아래 공식의 표기법은 두 가지 측면에서 이전 공식과 다릅니다:[19]

- 첫째, zx는 아래 공식에서 약간 다른 해석을 가집니다: 이것은 '(1 − x)-번째 분위-숫자'에 대해 약어가 아니라, '표준 정규 분포의 x번째 분위-숫자'의 그의 보통의 의미를 가집니다.

- 둘째, 이 공식은 두 경계를 정의하기 위해 더하기-빼기를 사용하지는 않습니다. 대신에, 우리는 아래쪽 경계를 얻기 위해 을 사용, 또는 위쪽 경계를 얻기 위해 를 사용할 수 있습니다. 예를 들어, 95% 신뢰 수준에 대해, 오차 = 0.05이므로, 우리는 를 사용함으로써 아래쪽 경계를 얻고, 우리는 을 사용하여 위쪽 경계를 얻습니다.

Comparison

정확한 (클로퍼–피어슨(Clopper–Pearson)) 방법이 가장 전통적입니다.[16]

발드 방법, 비록 교과서에서 공통적으로 권장될지라도, 가장 편향입니다.[clarification needed]

Related distributions

Sums of binomials

만약 X ~ B(n, p) 및 Y ~ B(m, p)는 같은 확률 p를 갖는 독립 이항 변수이면, X + Y는 다시 이항 변수입니다; 그것의 분포는 Z=X+Y ~ B(n+m, p)입니다:

어쨌든, 만약 X와 Y는 같은 확률 p를 가지지 않으면, 합의 분산이 으로 분포된 이항 변수의 분산보다 더 작을 것입니다.

Ratio of two binomial distributions

이 결과는 1978년에 Katz et al.에 의해 처음으로 유도되었습니다.[21]

X ~ B(n,p1) 및 Y ~ B(m,p2)를 독립으로 놓습니다. T = (X/n)/(Y/m)로 놓습니다.

그런-다음 log(T)는 평균 log(p1/p2) 및 분산 ((1/p1) − 1)/n + ((1/p2) − 1)/m를 갖는 근사적으로 정규적으로 분포된 것입니다.

Conditional binomials

만약 X ~ B(n, p) 및 Y | X ~ B(X, q) (주어진 X에 대한, Y의 조건부 분포)이면, Y가 분포 Y ~ B(n, pq)를 갖는 단순한 확률 변수입니다.

예를 들어, 바구니 UX에 n 공을 던지고 적중된 공을 취하고 그들을 또 다른 바구니 UY에 던지는 것을 생각해 보십시오. 만약 p가 UX에 적중할 확률이면, X ~ B(n, p)는 UX에 적중하는 공의 숫자입니다. 만약 q가 UY를 적중할 확률이면 UY를 적중하는 공의 숫자는 Y ~ B(X, q)이고 따라서 Y ~ B(n, pq)입니다.

및 이므로, 전체 확률의 법칙(law of total probability)에 의해,

이므로, 위의 방정식은 다음으로 표현될 수 있습니다:

를 인수화하고 이제 합에서 에 의존하지 않는 모든 항을 빼내면 다음을 산출합니다:

위의 표현에서 를 대입한 후에, 우리는 다음을 얻습니다:

위의 (괄호에서) 합은 이항 정리(binomial theorem)에 의해 와 같음을 주의하십시오. 이것을 치환하면 마침내 다음을 산출합니다:

그리고 따라서 원했던 것처럼 입니다.

Bernoulli distribution

베르누이 분포(Bernoulli distribution)는 n = 1인 이항 분포의 특수한 경우입니다. 기호적으로, X ~ B(1, p)는 X ~ Bernoulli(p)와 같은 의미를 가집니다. 역으로, 임의의 이항 분포, B(n, p)는 각각 같은 확률 p를 갖는 n 베르누이 시행(Bernoulli trials), Bernoulli(p)의 합의 분포입니다.[22]

Poisson binomial distribution

이항 분포는 푸아송 이항 분포(Poisson binomial distribution) 또는 일반적인 이항 분포(general binomial distribution)의 특수한 경우이며, 이것은 n 독립 비-동일 베르누이 시행(Bernoulli trials) B(pi)의 합의 분포입니다.[23]

Normal approximation

만약 n이 충분히 크면, 분포의 비뚤어짐이 너무 크지 않습니다. 이 경우에서 B(n, p)에 대한 합리적인 근사는 정규 분포(normal distribution)에 의해 제공됩니다:

그리고 이 기본 근사는 적절한 연속성 보정(continuity correction)을 사용함으로써 간단한 방법에서 개선될 수 있습니다. 기본 근사는 일반적으로 n이 증가함 (적어도 20)에 따라 개선되고 p가 0 또는 1에 가깝지 않을 때 더 좋습니다.[24] 다양한 엄지손가락의 규칙(rules of thumb)이 n이 충분하게 큰지, 및 p가 영 또는 일의 극단 값으로 충분히 먼지 여부를 결정하기 위해 사용될 수 있습니다:

- 한 가지 규칙은[24] n > 5에 대해 정규 근사가 만약 비뚤어짐의 절댓값이 1/3보다 엄격하게 작으면; 즉, 다음이면, 적당하다는 것입니다:

- 더 강한 규칙은 정규 근사는 오직 만약 그의 평균의 3 표준 편차 이내의 모든 것은 가능한 값의 법위 이내인 것; 즉, 오직 만약 다음이면, 적절하다고 말합니다:

- 이 3-표준-편차 규칙은 다음 조건과 동등하며, 이것은 위의 첫 번째 규칙을 역시 의미합니다.

규칙 는 다음임을 요청하는 것과 전적으로 동등합니다:

항을 적절히 이동하면 다음을 산출합니다:

이므로, 우리는 원하는 조건을 얻기 위해 제곱 거듭-제곱을 적용하고 각각 인수 및 로 나눌 수 있습니다:

이들 조건은 임을 자동적으로 의미함을 주의하십시오. 다른 한편으로, 다시 제곱근을 적용하고 3으로 나눕니다:

부등식의 첫 번째 집합으로부터 두 번째 것을 빼면 다음을 산출합니다:

그리고 따라서, 원했던 첫 번째 규칙은 만족됩니다:

- 또 다른 공통적으로 사용된 규칙은 양쪽 값 와 가 반드시 5보다 크거나 같은 것입니다. 어쨌든, 특정 숫자는 원천에서 원천으로 변하고, 우리가 원하는 근사가 얼마나 좋은지에 달려 있습니다. 특히, 만약 우리가 5 대신에 9를 사용하면, 규칙은 이전 단락에서 말했던 결과를 의미합니다.

양쪽 값 및 가 9보다 더 큰 것으로 가정합니다. 이므로, 우리는 쉽게 다음임을 가집니다:

우리는, 3-표준-편차 규칙의 대안적인 형식을 추론하기 위해, 이제 각각 인수 및 로 단지 나누어야 합니다:

다음은 연속성 보정(continuity correction)을 적용하는 것의 예제입니다. 우리가 이항 확률 변수 X에 대해 Pr(X ≤ 8)을 계산하기를 원한다고 가정합니다. 만약 Y가 정규 근사에 의해 제공된 분포를 가지면, Pr(X ≤ 8)은 Pr(Y ≤ 8.5)에 의해 근사됩니다. 0.5의 덧셈이 연속성 보정입니다; 비-보정된 정규 근사는 상당히 덜 정확한 결과를 제공합니다.

드 무아브르–라플라스 정리(de Moivre–Laplace theorem)로 알려진, 이 근사는 손으로 계산을 수행할 때 거대한 시간-절약기입니다 (큰 n을 갖는 정확한 계산은 매우 번거롭습니다); 역사적으로, 그것은 1738년에 아브라암 드 무아브르(Abraham de Moivre)의 책 The Doctrine of Chances에서 도입된 정규 분포의 첫 번째 사용이었습니다. 요즘, 그것은 중심 극한 정리(central limit theorem)의 결과로 이해될 수 있는데, 왜냐하면 B(n, p)는 매개-변수 p를 갖는 n 독립, 동일하게 분포된 베르누이 변수(Bernoulli variables)의 합입니다. 이 사실은, 공통 테스트 통계량(common test statistic)에서, x/n, 표본 비율 및 p의 추정기를 사용하여 p의 값에 대해, 가설 테스트(hypothesis test), "비례 z-테스트"의 기초입니다.[25]

예를 들어, 우리가 큰 모지단에서 n 사람들을 무작위로 추출하고 그들이 특정 성명서에 동의하는지 여부를 묻는다고 가정해 보십시오. 동의하는 사람의 비율은 물론 표본에 달려 있습니다. 만약 n 사람들의 그룹이 반복적이고 정말로 무작위로 추출되면, 비율은 모집단에서 동의의 참 비율의 평균과 같고 표준 편차 를 갖는 근사 정규 분포를 따라야 합니다.

Poisson approximation

이항 분포는 시행의 횟수가 무한대로 가지만 곱 np는 고정된 채로 남아있거나 적어도 p가 영으로 경향일 때 푸아송 분포(Poisson distribution)로 향해 수렴합니다. 그러므로, 매개-변수 λ = np를 갖는 푸아송 분포는 만약 n이 충분하게 크고 p가 충분하게 작으면 이항 분포의 B(n, p)에 대한 근사로 사용될 수 있습니다. 두 엄지손가락의 규칙에 따라, 이 근사는 만약 n ≥ 20 및 p ≤ 0.05이면, 또는 만약 n ≥ 100 및 np ≤ 10이면 좋습니다.[26]

푸아송 근사의 정확도에 관련하여, 노바크, 4장, 및 거기에서 참조를 보십시오.[27]

Limiting distributions

- 푸아송 극한 정리(Poisson limit theorem) : n이 ∞로 접근하고 np가 고정된 상태에서 p가 0에 접근할 때, 이항(n, p) 분포가 기댓값(expected value) λ = np를 갖는 푸아송 분포(Poisson distribution)에 접근합니다.[26]

- 드 무아브르–라플라스 정리(de Moivre–Laplace theorem): n이 ∞로 접근하지만 p가 고정된 채로 남겨질 때, 다음의 분포

- 는 기댓값 0과 분산(variance) 1을 갖는 정규 분포(normal distribution)로 접근합니다.[citation needed] 이 결과는 때때로 X의 분포가 기댓값 np 및 분산 np(1 − p)를 갖는 점근적으로 정규(asymptotically normal)이라고 말함으로써 느슨하게 말합니다. 이 결과는 중심 극한 정리(central limit theorem)의 특별한 경우입니다.

Beta distribution

이항 분포와 베타 분포는 반복된 베르누이 시행의 같은 모델의 다른 관점입니다. 이항 분포는 성공의 확률 p를 갖는 각각 n 독립 사건이 주어질 때 k 성공의 PMF입니다. 수학적으로, α = k + 1 및 β = n − k + 1일 때, 베타 분포와 이항 분포는 n + 1의 인수에 의해 관련됩니다:

베타 분포(Beta distribution)는 베이즈 추론(Bayesian inference)에서 이항 분포에 대해 이전 확률 분포(prior probability distribution)의 가족을 역시 제공합니다.:[28]

균등 이전이 주어지면, k 관찰된 성공을 갖는 n 독립 사건이 주어질 때 성공 p의 확률에 대해 이후 분포는 베타 분포입니다.[29]

Computational methods

Generating binomial random variates

주변 분포(marginal distribution)가 이항 분포인 무작위 숫자 생성기(random number generation)에 대해 방법은 잘 확립되어 있습니다.[30][31]

이항 분포에서 확률 표본을 생성하는 한 가지 방법은 반전 알고리듬을 사용하는 것입니다. 그렇게 하기 위해, 우리는 n을 통한 0으로부터 모든 값 k에 대해 Pr(X = k) 확률을 계산해야 합니다. (이들 확률은 전체 표본 공간을 포괄하기 위해 일에 가까운 값으로 합해야 합니다.) 그런-다음 유사-무작위 숫자 생성기(pseudorandom number generator)를 사용함으로써 0과 1 사이의 균등하게 표본을 생성하기 위해, 우리는 첫 번째 단계에서 계산된 확률을 사용함으로써 계산된 표본을 이산 숫자로 변환할 수 있습니다.

History

이 분포는 제임스 베르누이(James Bernoulli)에 의해 유도되었습니다. 그는 p = r/(r + s)인 경우를 고려했는데, 여기서 p는 성공 확률이고 r과 s는 양의 정수입니다. 블레즈 파스칼(Blaise Pascal)은 이전에 p = 1/2인 경우를 고려해 왔었습니다.

See also

- Logistic regression

- Multinomial distribution

- Negative binomial distribution

- Beta-binomial distribution

- Binomial measure, an example of a multifractal measure.[32]

- Statistical mechanics

References

- ^ Feller, W. (1968). An Introduction to Probability Theory and Its Applications (Third ed.). New York: Wiley. p. 151 (theorem in section VI.3).

- ^ Wadsworth, G. P. (1960). Introduction to Probability and Random Variables. New York: McGraw-Hill. p. 52.

- ^ Jowett G H (1963), The Relationship Between the Binomial and F Distributions, Journal of the Royal Statistical Society D, 13, 55-57.

- ^ See Proof Wiki

- ^ See also Nicolas, André (January 7, 2019). "Finding mode in Binomial distribution". Stack Exchange.

- ^ Neumann, P. (1966). "Über den Median der Binomial- and Poissonverteilung". Wissenschaftliche Zeitschrift der Technischen Universität Dresden (in German). 19: 29–33.

- ^ Lord, Nick. (July 2010). "Binomial averages when the mean is an integer", The Mathematical Gazette 94, 331-332.

- ^ a b Kaas, R.; Buhrman, J.M. (1980). "Mean, Median and Mode in Binomial Distributions". Statistica Neerlandica. 34 (1): 13–18. doi:10.1111/j.1467-9574.1980.tb00681.x.

- ^ Hamza, K. (1995). "The smallest uniform upper bound on the distance between the mean and the median of the binomial and Poisson distributions". Statistics & Probability Letters. 23: 21–25. doi:10.1016/0167-7152(94)00090-U.

- ^ Matoušek, J, Vondrak, J: The Probabilistic Method (lecture notes) [1].

- ^ a b R. Arratia and L. Gordon: Tutorial on large deviations for the binomial distribution, Bulletin of Mathematical Biology 51(1) (1989), 125–131 [2].

- ^ Theorem 11.1.3 in Cover, T.; Thomas, J. (2006). Elements of Information Theory (2nd ed.). Wiley. p. 350. ISBN 9781118585771.

- ^ "Sharper Lower Bounds for Binomial/Chernoff Tails". Stack Exchange. December 7, 2015.

- ^ M. Short: Improved Inequalities for the Poisson and Binomial Distribution and Upper Tail Quantile Functions, ISRN Probability and Statistics (2013), 412958 [3].

- ^ Razzaghi, Mehdi. "On the estimation of binomial success probability with zero occurrence in sample." Journal of Modern Applied Statistical Methods 1.2 (2002): 41. url

- ^ a b Brown, Lawrence D.; Cai, T. Tony; DasGupta, Anirban (2001), "Interval Estimation for a Binomial Proportion", Statistical Science, 16 (2): 101–133, CiteSeerX 10.1.1.323.7752, doi:10.1214/ss/1009213286, retrieved 2015-01-05

- ^ Agresti, Alan; Coull, Brent A. (May 1998), "Approximate is better than 'exact' for interval estimation of binomial proportions" (PDF), The American Statistician, 52 (2): 119–126, doi:10.2307/2685469, JSTOR 2685469, retrieved 2015-01-05

- ^ Pires M. A. Confidence intervals for a binomial proportion: comparison of methods and software evaluation.

- ^ Wilson, Edwin B. (June 1927), "Probable inference, the law of succession, and statistical inference" (PDF), Journal of the American Statistical Association, 22 (158): 209–212, doi:10.2307/2276774, JSTOR 2276774, archived from the original (PDF) on 2015-01-13, retrieved 2015-01-05

- ^ "Confidence intervals". Engineering Statistics Handbook. NIST/Sematech. 2012. Retrieved 2017-07-23.

- ^ Katz D. et al.(1978) "Obtaining confidence intervals for the risk ratio in cohort studies". Biometrics 34:469–474

- ^ Taboga, Marco. "Lectures on Probability Theory and Mathematical Statistics". statlect.com. Retrieved 18 December 2017.

- ^ Wang, Y. H. (1993). "On the number of successes in independent trials" (PDF). Statistica Sinica. 3 (2): 295–312. Archived from the original (PDF) on 2016-03-03.

- ^ a b Box, Hunter and Hunter (1978). Statistics for experimenters. Wiley. p. 130.

- ^ NIST/SEMATECH, "7.2.4. Does the proportion of defectives meet requirements?" e-Handbook of Statistical Methods.

- ^ a b NIST/SEMATECH, "6.3.3.1. Counts Control Charts", e-Handbook of Statistical Methods.

- ^ Novak S.Y. (2011) Extreme value methods with applications to finance. London: CRC/ Chapman & Hall/Taylor & Francis. ISBN 9781-43983-5746.

- ^ MacKay, David (2003). Information Theory, Inference and Learning Algorithms. Cambridge University Press; First Edition. ISBN 978-0521642989.

- ^ https://www.statlect.com/probability-distributions/beta-distribution

- ^ Devroye, Luc (1986) Non-Uniform Random Variate Generation, New York: Springer-Verlag. (See especially Chapter X, Discrete Univariate Distributions)

- ^ Kachitvichyanukul, V.; Schmeiser, B. W. (1988). "Binomial random variate generation". Communications of the ACM. 31 (2): 216–222. doi:10.1145/42372.42381.

- ^ Mandelbrot, B. B., Fisher, A. J., & Calvet, L. E. (1997). A multifractal model of asset returns. 3.2 The Binomial Measure is the Simplest Example of a Multifractal

Further reading

- Hirsch, Werner Z. (1957). "Binomial Distribution—Success or Failure, How Likely Are They?". Introduction to Modern Statistics. New York: MacMillan. pp. 140–153.

{{cite book}}: External link in|chapterurl=|chapterurl=ignored (|chapter-url=suggested) (help) - Neter, John; Wasserman, William; Whitmore, G. A. (1988). Applied Statistics (Third ed.). Boston: Allyn & Bacon. pp. 185–192. ISBN 0-205-10328-6.

External links

- Interactive graphic: Univariate Distribution Relationships

- Binomial distribution formula calculator

- Difference of two binomial variables: X-Y or |X-Y|

- Querying the binomial probability distribution in WolframAlpha

![{\displaystyle p\in [0,1]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/33c3a52aa7b2d00227e85c641cca67e85583c43c)

![{\displaystyle G(z)=[q+pz]^{n}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/40494c697ce2f88ebb396ac0191946285cadcbdd)

![{\displaystyle \operatorname {E} [X]=np.}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/3f16b365410a1b23b5592c53d3ae6354f1a79aff)

![{\displaystyle \operatorname {E} [X]=\operatorname {E} [X_{1}+\cdots +X_{n}]=\operatorname {E} [X_{1}]+\cdots +\operatorname {E} [X_{n}]=p+\cdots +p=np.}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/5f238d520c68a1d1b9b318492ddda39f4cc45bb8)

![{\displaystyle {\begin{aligned}\operatorname {P} (Z=k)&=\sum _{i=0}^{k}\left[{\binom {n}{i}}p^{i}(1-p)^{n-i}\right]\left[{\binom {m}{k-i}}p^{k-i}(1-p)^{m-k+i}\right]\\&={\binom {n+m}{k}}p^{k}(1-p)^{n+m-k}\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/38fc38e9a5e2c49743f45b4dab5dae6230ab2ad5)

![{\displaystyle {\begin{aligned}\Pr[Y=m]&=\sum _{k=m}^{n}\Pr[Y=m\mid X=k]\Pr[X=k]\\[2pt]&=\sum _{k=m}^{n}{\binom {n}{k}}{\binom {k}{m}}p^{k}q^{m}(1-p)^{n-k}(1-q)^{k-m}\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/7e8f896e04f3bc2c13d2eed61e48bd43e63f6406)

![{\displaystyle \Pr[Y=m]=\sum _{k=m}^{n}{\binom {n}{m}}{\binom {n-m}{k-m}}p^{k}q^{m}(1-p)^{n-k}(1-q)^{k-m}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/8369ef846ffda72900efc67b334923f70ce48ca5)

![{\displaystyle {\begin{aligned}\Pr[Y=m]&={\binom {n}{m}}p^{m}q^{m}\left(\sum _{k=m}^{n}{\binom {n-m}{k-m}}p^{k-m}(1-p)^{n-k}(1-q)^{k-m}\right)\\[2pt]&={\binom {n}{m}}(pq)^{m}\left(\sum _{k=m}^{n}{\binom {n-m}{k-m}}\left(p(1-q)\right)^{k-m}(1-p)^{n-k}\right)\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/caaa36dbcb3b4c43d7d5310533ef9d4809ba9db8)

![{\displaystyle \Pr[Y=m]={\binom {n}{m}}(pq)^{m}\left(\sum _{i=0}^{n-m}{\binom {n-m}{i}}(p-pq)^{i}(1-p)^{n-m-i}\right)}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/54401b2dd0936ca0904832912df2fe9b2c3d5153)

![{\displaystyle {\begin{aligned}\Pr[Y=m]&={\binom {n}{m}}(pq)^{m}(p-pq+1-p)^{n-m}\\[4pt]&={\binom {n}{m}}(pq)^{m}(1-pq)^{n-m}\end{aligned}}}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/324b106ed5f362da979eebfc0feaa94b44b713b2)