Probability theory

| Part of a series on statistics |

| Probability theory |

|---|

|

확률 이론(Probability theory)은 확률(probability)과 관련된 수학(mathematics)의 가지입니다. 비록 여러 다른 확률 해석(probability interpretations)이 있을지라도, 확률 이론은 공리(axioms)의 집합을 통해 표현함으로써 엄격한 수학적 방법에서 개념을 논합니다. 전형적으로 이들 공리는, 확률 측정(probability measure)으로 이름-지은, 0과 1 사이의 값을 취하는 측정(measure)을 표본 공간(sample space)으로 불리는 결과의 집합에 할당하는, 확률 공간(probability space)의 관점에서 확률을 공식화합니다. 이들 결과의 임의의 지정된 부분-집합은 사건(event)으로 불립니다.

확률 이론에서 중심 주제는 비-결정적(non-deterministic) 또는 불확실한 프로세서 또는 단일 발생 또는 임의의 방식으로 시간이 지남에 따라 진화될 수 있는 측정된 양(quantity)의 수학적 추상화를 제공하는, 이산 및 연속 확률 변수(random variables), 확률 분포(probability distributions) 및 확률적 프로세스(stochastic processes)를 포함합니다.

비록 확률 사건을 완벽하게 예측하는 것은 불가능하지만, 많은 것이 그들의 행동에 대해 말할 수 있습니다. 그러한 행동을 묘사하는 확률 이론에서 두 주요한 결과는 큰 숫자의 법칙(law of large numbers)과 중심 극한 정리(central limit theorem)입니다.

통계학(statistics)에 대해 수학적 토대로써, 확률 이론은 데이터의 정량적 해석을 포함하는 많은 인간 활동에 필수적입니다.[1] 확률 이론의 방법은, 통계 역학(statistical mechanics)에서 처럼, 그들의 상태의 단지 부분 지식을 제공되는 복잡 시스템의 설명에 역시 적용됩니다. 이십-세기 물리학(physics)의 위대한 발견은, 양자 역학(quantum mechanics)에 기술된, 원자 규모에서 물리적 현상의 확률론적 본질이었습니다.[2]

History of probability

확률 및 통계의 가장 초기에 알려진 형식은 8세기와 13세기 사이에 암호화(cryptography)를 연구하는 아랍 수학자들(Arab mathematicians)에 의해 개발되었습니다. 알-칼릴(Al-Khalil) (717–786)는 Book of Cryptographic Messages를 썼으며, 이것은 이것은 모음과 함께 및 모음없는 모든 가능한 아랍어(Arabic) 단어를 나열하기 위해 순열과 조합(permutations and combinations)의 첫 번째 사용을 포함합니다. 알-킨디(Al-Kindi) (801–873)는 암호-해독(cryptanalysis) 및 빈도 분석(frequency analysis)에 대한 그의 연구에서 통계적 추론(statistical inference)의 최초의 알려진 사용을 만들었습니다. 이븐 아들란(Ibn Adlan) (1187–1268)의 중요한 공헌은 빈도 분석의 사용에 대해 표본 크기(sample size)에 있었습니다.[3]

확률(probability)의 현대 수학적 이론은 16세기에서 제롤라모 카르다노(Gerolamo Cardano), 및 17세기에서 피에르 드 페르마(Pierre de Fermat)와 블레즈 파스칼(Blaise Pascal) (예를 들어 "득점의 문제"("problem of points"))에 의한 우연의 게임(games of chance)을 분석하려는 시도에 뿌리를 두고 있습니다. 크리스티안 하위헌스(Christiaan Huygens)는 1657년과 그 주제에 관한 책을 출간했고[4], 19세기에서, 피에르 라플라스(Pierre Laplace)는 오늘날 고전적 해석으로 여겨지는 것을 완성했습니다.[5]

초기에는, 확률 이론이 주로 이산 사건을 고려했었고, 그 방법은 주로 조합론적(combinatorial)이었습니다. 결국, 해석적(analytical) 고려-사항은 이론에서 연속 변수의 통합을 강요했습니다.

이것은, 안드레이 니콜라예비치 콜모고로프(Andrey Nikolaevich Kolmogorov)에 의해 세워진 토대에 대한, 현대 확률 이론에서 최고점에 도달했습니다. 콜모고로프는, 리카르트 폰 미제스(Richard von Mises)에 의해 도입된 표본 공간(sample space)의 개념, 및 측정 이론(measure theory)과 1933년에 확률 이론에 대해 제시된 그의 공리 시스템(axiom system)을 연결했습니다. 이것은 현대 확률 이론에 대해 가장 논의의 여지가 없는 공리적 기초(axiomatic basis)가 되었습니다; 그러나, 브루노 데 피네티(Bruno de Finetti)에 의한 셀 수 있는 덧셈성이 아닌 유한한 것의 채택과 같은, 대안이 존재합니다.[6]

Treatment

확률 이론에 대한 대부분의 소개는 이산 확률 분포와 연속 확률 분포를 분리해서 논의합니다. 확률의 측정 이론-기반 논의는 이산, 연속, 둘의 혼합, 등을 포함합니다.

Motivation

많은 결과를 생성할 수 있는 실험을 생각해 보십시오. 모든 결과의 집합은 실험의 표본 공간(sample space)으로 불립니다. 표본 공간의 거듭제곱 집합(power set) (또는 동등하게, 사건 공간)은 가능한 결과의 모든 다른 모음을 고려함으로써 형성됩니다. 예를 들어, 정직한 주사위를 굴리는 것은 여섯 가능한 결과 중 하나를 생성합니다. 가능한 결과의 하나의 모음은 홀수를 얻는 것에 해당합니다. 따라서, 부분-집합 {1,3,5}는 주사위 굴림의 표본 공간의 거듭제곱 집합의 원소입니다. 이들 모음은 사건(events)으로 불립니다. 이 경우에서, {1,3,5}는 주사위의 윗면이 어떤 홀수로 떨어지는 사건입니다. 만약 실제로 발생한 결과가 주어진 사건으로 떨어지면, 해당 사건이 발생했다고 말합니다.

확률은, 모든 가능한 결과로 만들어지는 사건 (이 예제에서, 사건 {1,2,3,4,5,6})이 일의 값을 할당하는 요구-사항과 함께, 모든 각 "사건"에 영과 일 사이의 값을 할당하는 것의 방법입니다. 확률 분포(probability distribution)로 자격을 얻기 위해, 값의 할당은, 만약 여러분이 서로 배타적 사건 (공통적인 결과가 없는 사건, 예를 들어, 사건 {1,6}, {3}, 및 {2,4}는 모두 서로 배타적입니다)의 모음을 보면, 이들 사건의 임의의 것이 발생할 확률은 사건들의 확률의 합에 의해 제공된다는 요구-조건을 반드시 만족시켜야 합니다.[7]

사건 {1,6}, {3}, 또는 {2,4} 중 임의의 하나가 발생할 확률은 5/6입니다. 이것은 사건 {1,2,3,4,6}의 확률이 5/6라고 말하는 것과 같습니다. 이 사건은 주사위를 굴렸을 때 5를 제외한 임의의 숫자의 가능성을 포함합니다. 서로 배타적 사건 {5}는 1/6의 확률을 가지고, 사건 {1,2,3,4,5,6}는 1의 확률, 즉, 절대적 확실성을 가집니다.

실험의 결과를 사용하여 계산을 행해질 때, 모든 그들의 기본 사건(elementary event)은 그들에게 할당된 숫자를 가져야 함이 필요합니다. 이것은 확률 변수(random variable)를 사용하여 행해집니다. 확률 변수는 표본 공간에서 각 기본 사건에 실수(real number)를 할당하는 함수입니다. 이 함수는 보통 대문자로 표시됩니다.[8] 주사위의 경우에서, 특정 기본 사건에 대한 숫자의 할당은 항등 함수(identity function)를 사용하여 행해질 수 있습니다. 이것은 항상 작동하는 것은 아닙니다. 예를 들어, 동전을 던질 때 두 가지 가능한 결과는 "앞면"과 "뒷면"입니다. 이 예제에서, 확률 변수 X는 결과 "앞면"에 숫자 "0" () 및 결과 "뒷면"에 숫자 "1" ()을 할당할 수 있습니다.

Discrete probability distributions

이산 확률 이론은 셀 수 있는(countable) 표본 공간에서 발생하는 사건을 다룹니다.

예제: 주사위 던지기, 카드의 덱(decks of cards)과 함께 실험, 무작위 걸음(random walk), 및 동전 던지기

고전적 정의: 초기에는 일어날 사건의 확률은, 확률이-같은 표본 공간에서 전체 결과의 숫자에 걸쳐, 사건에 대해 발생한 경우의 숫자로 정의되었습니다: 확률의 고전적 정의(Classical definition of probability)를 참조하십시오.

예를 들어, 만약 사건이 "주사위가 굴려졌을 때 짝수의 발생"이면, 확률은 에 의해 제공되는데, 왜냐하면 6개 중에서 3개의 면이 짝수이고 각 면은 발생하는 같은 확률을 가지기 때문입니다.

현대 정의: 현대 정의는 표본 공간(sample space)으로 불리는 유한 또는 셀-수-있는 집합으로 시작하며, 이것은 로 표시되는 고전적 의미에서 모든 가능한 결과의 집합과 관련됩니다. 그런-다음 각 원소 에 대해, 본질적인 "확률" 값 는 덧붙이며, 이것은 다음 속성을 만족시킨다고 가정합니다:

즉, 확률 함수 f(x)는 표본 공간 Ω에서 x의 모든 각 값에 대해 영과 일 사이에 놓이고, 표본 공간 Ω에서 모든 값 x에 걸쳐 f(x)의 합은 1과 같습니다. 사건(event)은 표본 공간 의 임의의 부분-집합(subset) 로 정의됩니다. 사건 의 확률은 다음으로 정의됩니다:

그래서, 전체 표본 공간의 확률은 1이고, 공사건(null event)의 확률은 0입니다.

표본 공간에서 한 점을 "확률" 값에 매핑하는 함수 는 pmf로 축약되는 확률 질량 함수(probability mass function)로 불립니다. 현대 정의는 확률 질량 함수가 어떻게 얻어지는지를 대답하려고 노력하지 않습니다; 대신에, 그것의 존재를 가정하는 이론을 세웁니다.[citation needed]

Continuous probability distributions

연속 확률 이론은 연속 표본 공간에서 발생하는 사건을 다룹니다.

고전적 정의: 고전적 정의는 연속적인 경우에 직면할 때 동작하지 않습니다. 베흐터어의 역설(Bertrand's paradox)을 참조하십시오.

현대 정의: 만약 확률 변수 X의 결과 공간이 실수(real numbers) ()의 집합 또는 그것의 부분-집합이면, 누적 분포 함수(cumulative distribution function) (또는 cdf)로 불리는 함수 가 존재하며, 에 의해 정의됩니다. 즉, F(x)는 X가 x보다 작거나 같을 확률을 반환합니다.

누적 분포 함수는 다음 속성을 만족시켜야 합니다:

만약 가 절대적으로 연속(absolutely continuous), 즉, 그의 도함수가 존재하고 도함수를 적분하면 cdf를 다시 복원하면, 확률 변수 X는 확률 밀도 함수(probability density function) 또는 pdf 또는 단순히 밀도 를 가지는 것으로 말합니다.

집합 에 대해, 안에 있는 확률 변수 X의 확률은 다음입니다:

확률 밀도 함수가 존재하는 경우에서, 이것은 다음으로 쓸 수 있습니다:

pdf가 연속 확률 변수에 대해 오직 존재하지만, cdf는 에서 값을 취하는 (이산 확률 변수를 포함하는) 모든 확률 변수에 대해 존재합니다.

이들 개념은 및 다른 연속 표본 공간 위의 다차원(multidimensional) 경우에 대해 일반화될 수 있습니다.

Measure-theoretic probability theory

확률의 측정-이론 처리의 raison d'être은 이산과 연속 경우를 통합하는 것이고, 어떤 측정이 사용되는지에 대한 질문으로 차이를 만듭니다. 게다가, 그것은 이산적인 것도 아니고 연속적인 것도 아니고 두 가지의 혼합도 아닌 분포를 포함합니다.

그러한 분포의 예제는 이산 분포와 연속 분포의 혼합이 있을 수 있습니다—예를 들어, 확률 1/2을 갖는 0인 확률 변수, 및 확률 1/2을 갖는 정규 분포로부터 무작위 값을 취합니다. 그것은 의 pdf를 가지는 것을 고려함으로써 일부 확장에 대해 여전히 연구될 수 있으며, 여기서 는 디랙 델타 함수(Dirac delta function)입니다.

다른 분포는 혼합조차 되지 않을 수 있으며, 예를 들어, 칸토어 분포(Cantor distribution)는 임의의 단일 점에 대해 양의 확률을 갖지 않고, 마찬가지로 밀도도 가지지 않습니다. 확률 이론에 대한 현대적 접근은 확률 공간(probability space)을 정의하기 위해 측정 이론(measure theory)을 사용하여 이들 문제를 해결합니다:

(역시, 표본 공간으로 불리는) 임의의 집합 와 그것 위의 σ-대수(σ-algebra) 가 주어지면, 위에 정의된 측정(measure) 는, 만약 이면, 확률 측정으로 불립니다.

만약 가 실수의 집합 위의 보렐 σ-대수(Borel σ-algebra)이면, 임의의 cdf에 대해 위의 유일한 확률 측정이 있고, 반대도 마찬가지입니다. 하나의 cdf에 해당하는 측정은 cdf에 의해 유도된다고 말합니다. 이 측정은 이산 변수에 대해 pmf 및 연속 변수에 대해 pdf와 일치하며, 측정-이론 접근에 오류가 없도록 만듭니다.

σ-대수 에서 집합 의 확률은 다음으로 정의됩니다:

여기서 적분화는 에 의해 유도된 측정 에 관해서 입니다.

이산 및 연속 확률의 보다 나은 이해와 통일을 제공함과 동시에, 측정-이론 처리는, 확률론적 프로세스(stochastic process)의 이론에서 처럼, 역시 바깥의 확률 위에 작동하는 것을 허용합니다. 예를 들어, 브라운 운동(Brownian motion)을 연구하기 위해, 확률은 함수의 공간 위에 정의됩니다.

지배적인 측정으로 동작하는 것이 편리할 때, 라돈-니코딤 정리(Radon-Nikodym theorem)가 이 지배적인 측정에 관하여 관심의 확률 분포의 라돈-니코딤 도함수로 밀도를 정의하기 위해 사용됩니다. 이산 밀도는 보통 모든 가능한 결과의 집합에 걸쳐 셈 측정(counting measure)에 관한 이 도함수로 정의됩니다. 절대적으로 연속(absolutely continuous) 분포에 대해 밀도는 보통 르베그 측정(Lebesgue measure)에 관한 이 도함수로 정의됩니다. 만약 정리가 이 일반적인 설정에서 증명될 수 있다면, 그것은 이산 및 연속 분배 둘 다에 대해 유지되고 다른 것도 마찬가지입니다; 별도의 증명은 이산 및 연속 분포에 대해 요구되지 않습니다.

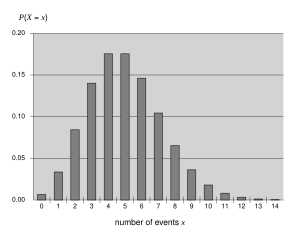

Classical probability distributions

특정 확률 변수는 확률 이론에서 매우 자주 발생하는데 왜냐하면 그들은 많은 자연적 또는 물리적 프로세스를 잘 설명하기 때문입니다. 그들의 분포는, 따라서, 확률 이론에서 특별히 중요성을 얻어-왔습니다. 일부 기본 이산 분포는 이산 균등(discrete uniform), 베르누이(Bernoulli), 이항(binomial), 음의 이항(negative binomial), 푸아송(Poisson) 및 기하 분포(geometric distribution)입니다. 중요한 연속 분포는 연속 균등(continuous uniform), 정규(normal), 지수(exponential), 감마(gamma) 및 베타 분포(beta distribution)를 포함합니다.

Convergence of random variables

확률 이론에서, 확률 변수(random variable)에 대해 수렴의 여러 개념이 있습니다. 그것들은 강도의 순서로 아래에 나열되어 있습니다. 즉, 목록에서 수렴의 임의의 후속의 개념은 모든 선행 개념에 따른 수렴을 의미합니다.

- 약한 수렴

- 확률 변수 의 수열은, 만약 그들의 각각의 누적 분포 함수 가, 가 연속(continuous)인 어디서든지, 의 누적 분포 함수 에 수렴하면, 확률 변수 에 대해 약하게(weakly) 수렴합니다. 약한 수렴은 역시 분포에서 수렴(convergence in distribution)으로 불립니다.

- 가장 공통적인 속기 표기법:

- 확률에서 수렴

- 확률 변수 의 수열은, 만약 모든 각 ε > 0에 대해 이면, 확률에서(in probability) 확률 변수 를 향해 수렴한다고 말합니다.

- 가장 공통적인 속기 표기법:

- 강한 수렴

- 확률 변수 의 수열은, 만약 이면, 강하게(strongly) 확률 변수 를 향해 수렴한다고 말합니다. 강한 수렴은 역시 거의 확실한 수렴(almost sure convergence)으로 알려져 있습니다.

- 가장 공통적인 속기 표기법:

이름이 가리키는 것처럼, 약한 수렴은 강한 수렴보다 더 약합니다. 사실, 강한 수렴은 확률에서 수렴을 의미하고, 확률에서 수렴은 약한 수렴을 의미합니다. 그 역 명제는 항상 참인 것은 아닙니다.

Law of large numbers

공통적인 직관은 만약 공정한 동전이 여러 번 던져지면, 회수의 대략 절반이 앞면일 것이고, 나머지 절반은 뒷면일 것이라고 제안합니다. 게다가, 더 자주 동전이 던져지면, 앞면의 숫자와 뒷면의 숫자의 비율은 단위로 가까워질 가능성이 높아질 것입니다. 현대 확률 이론은, 큰 숫자의 법칙(law of large numbers)으로 알려진, 이 직관적인 아이디어의 공식적인 버전을 제공합니다. 이 법칙은 확률 이론의 토대에서 가정되지 않지만, 대신에 정리로 이들 토대로부터 나타나기 때문에 주목할 만합니다. 그것은 이론적으로 도출된 확률을 현실 세계에서 실제 발생의 빈도와 연결하므로, 큰 숫자의 법칙은 통계적 이론의 역사에서 기둥으로 여겨지고 널리 영향을 미쳐 왔습니다.[9]

큰 숫자의 법칙(law of large numbers, 줄여서 LLN)은 독립이고 동일하게 분포된 확률 변수 의 수열의 표본 평균

은 그들의 공통 기댓값 를 향해 수렴하며, 의 기댓값은 유한인 조건으로 제공됩니다.

큰 숫자의 약한 법칙과 강한 법칙을 분리하는 확률 변수의 수렴(convergence of random variables)의 다른 형식이 있습니다:

- 약한 법칙: for

- 강한 법칙: for

만약 확률 p의 사건이 독립적인 실험 동안 반복적으로 관찰되면, 반복의 전체 횟수에 대한 사건의 관찰된 빈도의 비율은 p를 향해 수렴하는 것은 LLN으로부터 따릅니다.

예를 들어, 만약 이 확률 p를 갖는 값 1 및 확률 1-p를 갖는 0을 취하는 독립적인 베르누이 확률 변수(Bernoulli random variables)이면, 는 p에 거의 확실하게(almost surely) 수렴하도록, 모든 i에 대해 입니다.

Central limit theorem

"중심 극한 정리 (CLT)는 수학의 두드러진 결과 중 하나입니다." ([10]의 18 장) 그것은 본질적으로 정규 분포(normal distribution)의 유비쿼터스 발생을 설명합니다.

그 정리는 유한 분산을 갖는 많은 독립적이고 동일하게 분포된 확률 변수의 평균(average)은 원래 확률 변수에 의해 뒤따르는 분포에 관계없이 정규 분포를 향하는 경향이 있다고 말합니다. 형식적으로, 을 평균(mean) 및 분산(variance) 을 갖는 독립 확률 변수로 놓습니다. 그런-다음, 확률 변수의 수열

은 표준 정규(standard normal) 확률 변수에 대한 분포에서 수렴합니다.

확률 변수의 일부 클래스에 대해, 고전적인 중심 극한 정리는, 예를 들어 지수 가족(exponential family)으로부터 유한한 첫 번째, 두 번째, 및 세 번째 모멘트를 갖는 분포에서, 다소 빠르게 작동합니다 (베리–에센 정리(Berry–Esseen theorem)를 참조하십시오); 다른 한편으로, 두꺼운 꼬리(heavy tail)와 뚱뚱한 꼬리(fat tail) 다양성의 일부 확률 변수에 대해, 매우 느리게 작동하거나 전혀 작동하지 않을 수 있습니다: 그런 경우에서 우리는 일반화된 중심 극한 정리(Generalized Central Limit Theorem, 줄여서 GCLT)를 사용할 수 있을 것입니다.

See also

- Catalog of articles in probability theory

- Expected value and Variance

- Fuzzy logic and Fuzzy measure theory

- Glossary of probability and statistics

- Likelihood function

- List of probability topics

- List of publications in statistics

- List of statistical topics

- Notation in probability

- Predictive modelling

- Probabilistic logic – A combination of probability theory and logic

- Probabilistic proofs of non-probabilistic theorems

- Probability distribution

- Probability axioms

- Probability interpretations

- Probability space

- Statistical independence

- Subjective logic

Notes

- ^ Inferring From Data

- ^ "Why is quantum mechanics based on probability theory?". StackExchange. July 1, 2014.[unreliable source?]

- ^ Broemeling, Lyle D. (1 November 2011). "An Account of Early Statistical Inference in Arab Cryptology". The American Statistician. 65 (4): 255–257. doi:10.1198/tas.2011.10191.

- ^ Grinstead, Charles Miller; James Laurie Snell. "Introduction". Introduction to Probability. pp. vii.

- ^ Hájek, Alan. "Interpretations of Probability". Retrieved 2012-06-20.

{{cite web}}: Unknown parameter|booktitle=ignored (help) - ^ ""The origins and legacy of Kolmogorov's Grundbegriffe", by Glenn Shafer and Vladimir Vovk" (PDF). Retrieved 2012-02-12.

- ^ Ross, Sheldon (2010). A First Course in Probability (8th ed.). Pearson Prentice Hall. pp. 26–27. ISBN 978-0-13-603313-4. Retrieved 2016-02-28.

- ^ Bain, Lee J.; Engelhardt, Max (1992). Introduction to Probability and Mathematical Statistics (2nd ed.). Belmont, California: Brooks/Cole. p. 53. ISBN 978-0-534-38020-5.

- ^ "Leithner & Co Pty Ltd - Value Investing, Risk and Risk Management - Part I". Leithner.com.au. 2000-09-15. Archived from the original on 2014-01-26. Retrieved 2012-02-12.

- ^ David Williams, "Probability with martingales", Cambridge 1991/2008

References

- Pierre Simon de Laplace (1812). Analytical Theory of Probability.

- The first major treatise blending calculus with probability theory, originally in French: Théorie Analytique des Probabilités.

- A. Kolmogoroff (1933). Grundbegriffe der Wahrscheinlichkeitsrechnung. doi:10.1007/978-3-642-49888-6. ISBN 978-3-642-49888-6.

- An English translation by Nathan Morrison appeared under the title Foundations of the Theory of Probability (Chelsea, New York) in 1950, with a second edition in 1956.

- Patrick Billingsley (1979). Probability and Measure. New York, Toronto, London: John Wiley and Sons.

- Olav Kallenberg; Foundations of Modern Probability, 2nd ed. Springer Series in Statistics. (2002). 650 pp. ISBN 0-387-95313-2

- Henk Tijms (2004). Understanding Probability. Cambridge Univ. Press.

- A lively introduction to probability theory for the beginner.

- Olav Kallenberg; Probabilistic Symmetries and Invariance Principles. Springer -Verlag, New York (2005). 510 pp. ISBN 0-387-25115-4

- Gut, Allan (2005). Probability: A Graduate Course. Springer-Verlag. ISBN 0-387-22833-0.

External links

- Probability Theory demonstrated in the Galton Board

- Animation on YouTube on the probability space of dice.

![{\displaystyle f(x)\in [0,1]{\mbox{ for all }}x\in \Omega \,;}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/d9fb6901c7d0c1686386da77b3a2af38bc0d7952)

![{\displaystyle (\delta [x]+\varphi (x))/2}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/b59e7c343760eb33e805760c20aff9d9c3831260)

![{\displaystyle \delta [x]}](https://dawoum.duckdns.org/api/rest_v1/media/math/render/svg/3953eacd8865ec4c182566de1728419117164d2c)